Google Cloud fournit des images contenant des systèmes d'exploitation, des frameworks, des bibliothèques et des pilotes courants. Google Cloud optimise ces images préconfigurées pour prendre en charge vos charges de travail d'intelligence artificielle (IA) et de machine learning (ML).

Ce document présente les images que vous utilisez pour déployer, gérer et exécuter des charges de travail dans votre environnement AI Hypercomputer.

Comprendre les catégories d'images

Les images sont regroupées dans les catégories suivantes :

- Frameworks et bibliothèques d'IA et de ML : images Docker préconfigurées avec des binaires pour les frameworks et bibliothèques de ML afin de simplifier la création, l'entraînement et l'utilisation de modèles de ML. Sur AI Hypercomputer, vous pouvez utiliser les images Docker Deep Learning Software Layer (DLSL) pour exécuter des modèles de ML comme NeMO et MaxText sur un cluster Google Kubernetes Engine (GKE).

- Déploiement et orchestration de clusters : images de système d'exploitation (OS) que vous utilisez pour déployer et gérer l'infrastructure optimisée pour les performances sur laquelle s'exécutent vos charges de travail d'IA. Vous pouvez déployer vos charges de travail d'IA sur des clusters GKE, des clusters Slurm ou des instances Compute Engine.

Pour en savoir plus, consultez Présentation de la création de VM et de clusters.

Les images de système d'exploitation suivantes sont disponibles pour le déploiement de clusters ou d'instances :

- Images de nœuds GKE : vous pouvez utiliser ces images pour déployer des clusters GKE.

- Images d'OS Slurm : Cluster Toolkit crée et déploie ces images, qui installent le logiciel système nécessaire pour les nœuds Slurm.

- Images d'OS d'accélérateur : vous pouvez utiliser ces images pour créer des instances individuelles ou des groupes d'instances.

Frameworks et bibliothèques d'IA et de ML

Google Cloud fournit des images Docker qui regroupent des frameworks et des bibliothèques d'IA et de ML populaires. Ces images fournissent le logiciel nécessaire pour simplifier le développement, l'entraînement et le déploiement de modèles sur vos clusters optimisés pour l'IA exécutés sur AI Hypercomputer.

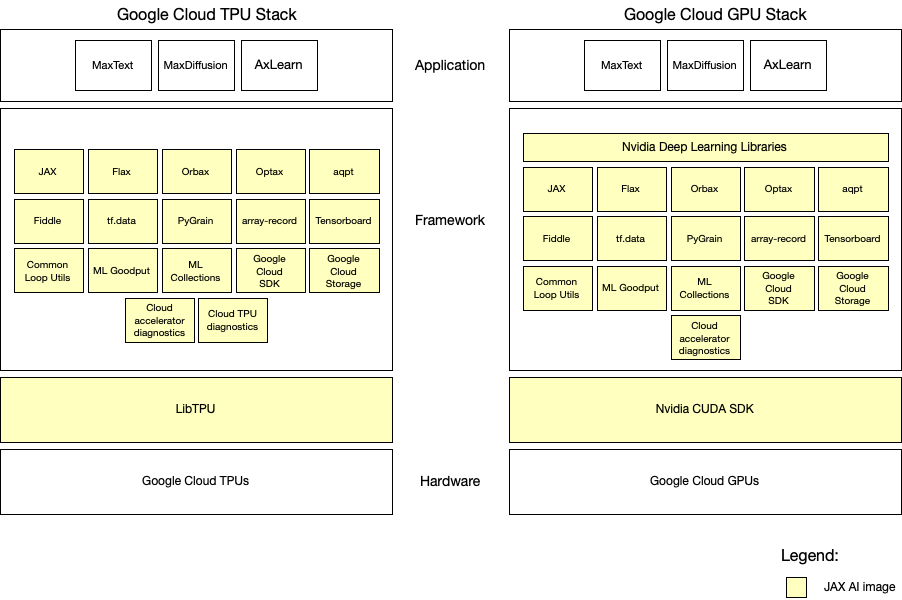

Images JAX AI

Les images JAX AI (JAII, anciennement appelées images de pile stable JAX) pour les TPU et les GPUGoogle Cloud proposent des images Docker prêtes à l'emploi qui contiennent le framework JAX, une collection sélectionnée de bibliothèques compatibles et des paramètres pour l'infrastructure Google Cloud . Les images JAX AI TPU sont préconfigurées avec les bibliothèques JAX et les bibliothèques TPU. Les images de GPU JAX AI sont préconfigurées avec les bibliothèques JAX et les bibliothèques CUDA/NVIDIA appropriées.

La couche matérielle

Les images JAX AI se trouvent au-dessus de la couche matérielle, qui se compose des accélérateurs (TPU ou GPU) et de leurs VM associées. Pour utiliser une image JAX AI, vous devez provisionner des VM TPU ou GPU. Pour ce faire, vous pouvez utiliser l'API TPU, l'API Compute Engine ou l'API GKE.

La couche de framework

La couche Framework fournit des outils et des bibliothèques pour créer des charges de travail de ML. Les images JAX AI fournissent une base préconfigurée pour les charges de travail de ML basées sur JAX, y compris la bibliothèque JAX principale et d'autres dépendances essentielles, afin de garantir une expérience de développement cohérente et performante.

Le calque LibTPU de l'image JAX AI est spécifiquement conçu et fourni avec la version JAX correspondante. L'utilisation d'une autre version de JAX peut entraîner des comportements ou des erreurs inattendus.

La couche CUDA de l'image JAX AI inclut des composants gérés par NVIDIA, tels que l'image NGC CUDA Deep Learning, utilisée comme image de base de l'image d'entraînement GPU. L'image GPU contient également Transformer Engine, une bibliothèque NVIDIA personnalisée permettant d'accélérer les modèles de transformateurs sur les GPU NVIDIA.

Des packages supplémentaires spécifiques à l'application, en plus de ceux fournis dans l'image JAX AI, peuvent être nécessaires pour votre charge de travail de machine learning spécifique.

Bibliothèques dans JAX AI Images :

Images de TPU

| Fonctionnalités | Nom du package |

|---|---|

| Bibliothèques ou composants principaux | |

| Framework de ML | JAX et JAX lib |

| LibTPU | Version stable de Cloud LibTPU |

| Bibliothèque de calques/modèles | Flax |

| Points de contrôle | Orbax |

| Quantification | Qwix |

| Optimiseurs | Optax |

| Noyaux personnalisés | Tokamax |

| Config | Fiddle |

| Pipeline d'entrée | tf.data |

| Profilage, débogage | TensorBoard |

| Utils | Utilitaires de boucle courants |

| Outils spécifiques au cloud | |

| Google Cloud | |

| Diagnostic | |

Images de GPU

| Fonctionnalités | Nom du package |

|---|---|

| Bibliothèques ou composants principaux | |

| Framework de ML | JAX et JAX lib |

| Bibliothèques NVIDIA CUDA | Image CUDA DL |

| Bibliothèque de calques/modèles | Flax |

| Points de contrôle | Orbax |

| Optimiseurs | |

| Config | Fiddle |

| Pipeline d'entrée | |

| Profilage, débogage | TensorBoard |

| Utils |

Utilitaires de boucle courants Mesure du goodput de ML Collections de ML |

| Outils spécifiques au cloud | |

| Google Cloud | |

| Diagnostic | Diagnostics Cloud Accelerator |

Images JAX AI actuelles

Images de TPU

| Image JAX AI | Date de disponibilité |

|---|---|

| JAX 0.9.0, révision 1 | 2026-02-03 |

| JAX 0.8.2, révision 1 | 2026-01-14 |

| JAX 0.8.1, révision 1 | 2025-11-21 |

| JAX 0.8.0, révision 1 | 2025-10-28 |

| JAX 0.7.2, révision 1 | 2025-09-30 |

| JAX 0.7.0, révision 1 | 2025-07-29 |

| JAX 0.6.1, révision 1 | 2025-06-05 |

| JAX 0.5.2, révision 2 | 2025-04-25 |

| JAX 0.5.2, révision 1 | 2025-03-17 |

| JAX 0.4.37, révision 1 | 2024-12-12 |

| JAX 0.4.35 Révision 1 | 2024-10-30 |

Images de GPU

| Image JAX AI | Date de disponibilité |

|---|---|

| JAX 0.7.2 avec CUDA DL 25.06 révision 1 | 2025-09-30 |

| JAX 0.6.1 avec CUDA DL 25.03 révision 1 | 2025-06-05 |

| JAX 0.5.1 avec CUDA DL 25.02 révision 1 | 2025-03-17 |

Couche d'application

Vous implémentez vos charges de travail de ML spécifiques dans la couche d'application, qui se trouve au-dessus de la couche de framework. La couche Application contient le code, les modèles et la logique spécifiques à votre application, tous créés à l'aide des outils et des bibliothèques fournis par la couche Framework.

Bien que cette image fournisse une base robuste et bien testée pour les charges de travail d'IA basées sur JAX, vous devrez peut-être ajouter des dépendances spécifiques à l'application. Dans ce cas, nous vous recommandons de le faire de manière à minimiser les interférences avec la couche de base préconfigurée, qui inclut JAX et ses dépendances principales. L'introduction de dépendances au niveau de l'application qui remplacent ou entrent en conflit avec les dépendances existantes peut entraîner des effets secondaires tels que :

- Comportements inattendus : vos charges de travail de ML peuvent présenter un comportement différent de celui qu'elles avaient avant que vous n'introduisiez des dépendances supplémentaires dans l'image JAX AI.

- Régression des performances : le remplacement des bibliothèques optimisées associées à JAX peut avoir un impact négatif sur les avantages en termes de performances fournis par l'image JAX AI.

- Problèmes de stabilité : les conflits entre les dépendances que vous avez ajoutées et les dépendances JAX principales peuvent entraîner une instabilité et des erreurs d'exécution dans votre application.

Fréquence de publication

Dans un premier temps, les images JAX AI seront fournies tous les trimestres. L'objectif à court terme est de synchroniser le calendrier de publication avec chaque version de JAX. Vous pourrez ainsi bénéficier des dernières fonctionnalités et améliorations dès qu'elles seront disponibles.

Assistance

Chaque version d'image JAX AI est associée à un cycle de vie de compatibilité limité dans le temps. Pendant cette période, nous traitons des catégories spécifiques de demandes de modification d'images JAX AI existantes :

- Failles de sécurité : nous accordons la priorité à la résolution des failles de sécurité découvertes dans les images de base ou les dépendances des images Docker JAX Stable Stack. Des images mises à jour seront publiées pour atténuer les risques potentiels.

- Modifications destructives : en cas de modifications destructives importantes dans les bibliothèques ou les frameworks sous-jacents utilisés par JAX AI Image, Google Cloudévalue et implémente les mises à jour nécessaires pour maintenir la compatibilité. Cela peut impliquer de recréer des images Docker avec des dépendances mises à jour.

Lorsqu'une faille ou un bug de sécurité sont découverts dans une bibliothèque d'un JAII, nous intégrons la bibliothèque mise à jour dans le JAII, en épinglant toutes les autres versions de bibliothèque pour maintenir la stabilité globale. Cela entraîne une nouvelle révision de JAII.

Modification minimale pour les révisions :

Si un bug est détecté dans le package "X" de JAX-0.4.30-rev1, nous mettrons à jour "X" vers sa prochaine version (par exemple, v2.0) tout en essayant de conserver tous les autres packages inchangés. Une nouvelle révision, JAX-0.4.30-rev2, sera publiée dès que possible.

Images Docker de la couche logicielle de deep learning (DLSL)

Ces images regroupent NVIDIA CUDA, NCCL, un framework de ML et un modèle. Ils fournissent un environnement prêt à l'emploi pour les charges de travail de deep learning. Ces images Docker DLSL prédéfinies fonctionnent parfaitement avec vos clusters GKE, car nous les testons et les vérifions lors de tests internes de reproductibilité et de régression.

Les images Docker DLSL offrent les avantages suivants :

- Logiciel préconfiguré : les images Docker DLSL reproduisent la configuration utilisée pour les tests internes de reproductibilité et de régression. Ces images fournissent un environnement préconfiguré, testé et optimisé, ce qui permet de gagner beaucoup de temps et d'efforts lors de l'installation et de la configuration.

- Gestion des versions : les images Docker DLSL sont fréquemment mises à jour. Ces mises à jour de version fournissent la dernière version stable des frameworks et des pilotes, et elles incluent également des correctifs de sécurité.

- Compatibilité de l'infrastructure : les images Docker DLSL sont conçues et testées pour fonctionner de manière fluide avec les types de machines GPU disponibles sur AI Hypercomputer.

- Instructions de démarrage rapide : certaines images Docker DLSL sont accompagnées d'exemples de recettes qui vous montrent comment démarrer vos charges de travail utilisant les images préconfigurées.

Plug-in gIB NeMo + PyTorch + NCCL

Ces images Docker sont basées sur l'image NVIDIA NeMo NGC. Ils contiennent le plug-in gIB NCCL de Google et regroupent tous les binaires NCCL nécessaires à l'exécution des charges de travail sur chaque machine d'accélérateur compatible. Ces images incluent également des outils Google Cloudtels que gcsfuse et l'

interface de ligne de commande gcloud pour déployer des charges de travail sur Google Kubernetes Engine.

| Version de l'image DLSL | Version des dépendances | Série de machines | Date de disponibilité | Date de fin d'assistance | Nom de l'image DLSL |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3 juillet 2025 | 3 juillet 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3 juillet 2025 | 3 juillet 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14 mars 2025 | 14 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2 février 2025 | 2 février 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2 février 2025 | 2 février 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7 février 2025 | 7 février 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 mars 2025 | 12 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPU) | 12 mars 2025 | 12 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

Cette image Docker est basée sur l'image NVIDIA NeMo NGC et inclut des outils Google Cloud tels que gcsfuse et la

Google Cloud CLI pour déployer des charges de travail sur Google Kubernetes Engine.

| Version de l'image DLSL | Version des dépendances | Série de machines | Date de disponibilité | Date de fin d'assistance | Nom de l'image DLSL |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 19 décembre 2024 | 19 décembre 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 mars 2025 | 12 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPU) | 12 mars 2025 | 12 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

Boîte à outils MaxText + JAX

Cette image Docker est basée sur l'image de la boîte à outils NVIDIA JAX et inclut des outilsGoogle Cloud tels que gcsfuse et la

CLI gcloud pour déployer des charges de travail sur Google Kubernetes Engine.

| Version de l'image DLSL | Version des dépendances | Série de machines | Date de disponibilité | Date de fin d'assistance | Nom de l'image DLSL |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11 mars 2025 | 11 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17 mars 2025 | 17 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 GPU) | 17 mars 2025 | 17 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX Stable Stack

Cette image Docker est basée sur la pile stable JAX et MaxText. Cette image inclut également des dépendances telles que dnsutils pour exécuter des charges de travail sur Google Kubernetes Engine.

| Version de l'image DLSL | Version des dépendances | Série de machines | Date de disponibilité | Date de fin d'assistance | Nom de l'image DLSL |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17 mars 2025 | 17 mars 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Déploiement et orchestration de clusters

Les images d'OS incluent tous les composants logiciels nécessaires au déploiement d'un système d'exploitation sur une instance de calcul ou un nœud GKE. Le système d'exploitation gère les ressources matérielles sous-jacentes, telles que les accélérateurs et la mise en réseau. Cela fournit les ressources de calcul pour votre charge de travail d'IA.

Images de nœuds GKE

GKE déploie des clusters à l'aide d'images de nœuds. Ces images de nœuds sont disponibles pour différents systèmes d'exploitation tels que Container-Optimized OS, Ubuntu et Windows Server. Les images de nœud Container-Optimized OS avec containerd (cos_containerd) dont vous avez besoin pour déployer des clusters GKE Autopilot incluent des optimisations pour prendre en charge vos charges de travail d'IA et de ML.

Pour en savoir plus sur ces images de nœud, consultez Images de nœuds.

Images d'OS Slurm

Les clusters Slurm déploient des nœuds de calcul et de contrôleur en tant qu'instances de calcul sur Compute Engine.

Pour provisionner des clusters Slurm optimisés pour l'IA, vous devez utiliser Cluster Toolkit. Lors du déploiement du cluster Slurm, le blueprint de cluster crée automatiquement une image d'OS personnalisée qui installe le logiciel système requis pour la gestion du cluster et de la charge de travail sur les nœuds Slurm. Vous pouvez modifier les plans par défaut avant de les déployer pour personnaliser certains des logiciels inclus dans vos images.

La section suivante récapitule les logiciels que le blueprint de cluster installe sur vos nœuds Slurm A4, A3 Ultra, A3 Mega et A3 High (8 GPU). Les blueprints de cluster étendent les images d'OS Ubuntu LTS Accelerator.

A4X Max

Le plan A4X Max disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 24.04 LTS

- Slurm : version 25.05.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : version 5.0.x

- Client et serveur NFS

- Pilotes NVIDIA série 580

- NVIDIA Enroot

- NVIDIA Pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) nvidia-container-toolkit: version 1.17.7nvidia-imexnvidia-fabricmanager

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 13.0

- Plug-in NCCL pour A4X Max (

nccl-gib-a4x-max-arm64) - Pilote DOCA-OFED

- Agent Ops

- Cloud Storage FUSE

A4X

Le blueprint A4X disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 24.04 LTS

- Slurm : version 25.05.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : version 5.0.x

- Client et serveur NFS

- Pilotes NVIDIA série 570

- NVIDIA Enroot

- NVIDIA Pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) nvidia-container-toolkit: version 1.17.7nvidia-imexnvidia-fabricmanager

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 12.8

- Plug-in NCCL pour A4X (

nccl-plugin-gib-arm64) - Agent Ops

- Cloud Storage FUSE

A4

Le blueprint A4 disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 22.04 LTS

- Slurm : version 25.05.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : dernière version de 4.1.x

- PMIx : version 4.2.9

- Client et serveur NFS

- Pilotes NVIDIA série 570

- Environnement d'exécution de conteneur NVIDIA enroot : version 3.5.0 avec correction de bug post-version

- NVIDIA pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 12.8

- Prise en charge d'Infiniband, y compris

ibverbs-utils - Agent Ops

- Cloud Storage FUSE

A3 Ultra

Le plan A3 Ultra disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 22.04 LTS

- Slurm : version 24.11.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : dernière version de 4.1.x

- PMIx : version 4.2.9

- Client et serveur NFS

- Pilotes NVIDIA série 570

- Environnement d'exécution de conteneur NVIDIA enroot : version 3.5.0 avec correction de bug post-version

- NVIDIA pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 12.8

- Prise en charge d'Infiniband, y compris

ibverbs-utils - Agent Ops

- Cloud Storage FUSE

A3 Mega

Le plan A3 Mega disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 22.04 LTS

- Slurm : version 24.11.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : dernière version de 4.1.x

- PMIx : version 4.2.9

- Client et serveur NFS

- Pilotes NVIDIA série 550

- Environnement d'exécution de conteneur NVIDIA enroot : version 3.4.1

- NVIDIA pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 12.4

- Prise en charge d'Infiniband, y compris

ibverbs-utils - TCPXO pour A3 Mega : programme d'installation spécifique pour NCCL TCPXO et la pile réseau de 1,6 Tbit/s

- Agent Ops

- Cloud Storage FUSE

A3 High

Le blueprint A3 High (8 GPU) disponible sur GitHub inclut les logiciels suivants par défaut :

- Ubuntu 22.04 LTS

- Slurm : version 24.11.2

- Les dépendances Slurm suivantes :

mungemariadblibjwtlmod

- Open MPI : dernière version de 4.1.x

- PMIx : version 4.2.9

- Client et serveur NFS

- Pilotes NVIDIA des séries 535 ou 550

- NVIDIA enroot container runtime : version 3.4.1

- NVIDIA pyxis

- Les outils NVIDIA suivants :

- Gestionnaire GPU de centre de données (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Gestionnaire GPU de centre de données (

- CUDA Toolkit : version 12.2 ou 12.4

- Prise en charge d'Infiniband, y compris

ibverbs-utils - TCPX pour A3 High (8 GPU) : programme d'installation spécifique pour NCCL TCPX (GPUDirect-TCPX) et la pile réseau de 800 Gbit/s (4 cartes d'interface réseau)

- Agent Ops

- Cloud Storage FUSE

Images d'OS pour les accélérateurs

AI Hypercomputer vous permet de provisionner des instances de calcul individuelles ou des groupes d'instances de calcul. Si vous souhaitez créer ces instances, vous devez spécifier une image d'OS lors de la création de l'instance.

Google Cloud propose une suite d'images d'OS pour la création d'instances. Google Cloud propose également un ensemble spécialisé d'images d'OS pour les accélérateurs, destinées aux instances optimisées pour l'IA. Ces images d'OS incluent les pilotes principaux pour les fonctionnalités de GPU et de mise en réseau, telles que les pilotes NVIDIA et Mellanox, ainsi que leurs dépendances.

Pour en savoir plus sur chaque système d'exploitation, consultez la page Détails des systèmes d'exploitation dans la documentation Compute Engine.

Des images d'OS pour les accélérateurs sont disponibles pour les systèmes d'exploitation Rocky Linux et Ubuntu LTS.

Accélérateur Rocky Linux

Les images d'OS Rocky Linux Accelerator suivantes sont disponibles pour chaque série de machines :

| Version d'OS | Famille d'images | Architecture | Série de machines | Projet de l'image |

|---|---|---|---|---|

| Accélérateur Rocky Linux 9 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

| Accélérateur Rocky Linux 8 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

Accélérateur Ubuntu LTS

Les images d'OS Ubuntu LTS pour les accélérateurs suivantes sont disponibles pour chaque série de machines :

| Version d'OS | Famille d'images | Architecture | Série de machines | Projet de l'image |

|---|---|---|---|---|

| Accélérateur Ubuntu 24.04 LTS | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

| Accélérateur Ubuntu 22.04 LTS | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |