Pode usar o Enterprise Document OCR como parte da Document AI para detetar e extrair texto e informações de esquema de vários documentos. Com funcionalidades configuráveis, pode adaptar o sistema para cumprir requisitos específicos de processamento de documentos.

Vista geral

Pode usar o OCR de documentos empresariais para tarefas como a introdução de dados com base em algoritmos ou aprendizagem automática, bem como para melhorar e validar a precisão dos dados. Também pode usar o Enterprise Document OCR para processar tarefas como as seguintes:

- Digitalizar texto: extraia texto e dados de esquemas de documentos para pesquisa, pipelines de processamento de documentos baseados em regras ou criação de modelos personalizados.

- Usar aplicações de modelos de linguagem (conteúdo extenso): use a compreensão contextual dos GMLs e as capacidades de extração de texto e esquemas da OCR para automatizar perguntas e respostas. Aceda a estatísticas a partir de dados e simplifique fluxos de trabalho.

- Arquivo: digitalize documentos em papel em texto legível por máquina para melhorar a acessibilidade dos documentos.

Escolher o melhor OCR para o seu exemplo de utilização

| Solução | Produto | Descrição | Exemplo de utilização |

|---|---|---|---|

| Document AI | Enterprise Document OCR | Modelo especializado para exemplos de utilização de documentos. As funcionalidades avançadas incluem a classificação da qualidade da imagem, sugestões de idiomas e correção da rotação. | Recomendado quando extrai texto de documentos. Os exemplos de utilização incluem PDFs, documentos digitalizados como imagens ou ficheiros Microsoft DocX. |

| Document AI | Suplementos de OCR | Funcionalidades premium para requisitos específicos. Apenas compatível com a versão 2.0 e posterior do Enterprise Document OCR. | Precisam de detetar e reconhecer fórmulas matemáticas, receber informações de estilo de letra ou ativar a extração de caixas de verificação. |

| API Cloud Vision | Deteção de texto | API REST disponível globalmente baseada no Google Cloud modelo de ROC padrão. Quota predefinida de 1800 pedidos por minuto. | Exemplos de utilização de extração de texto geral que requerem baixa latência e alta capacidade. |

| Cloud Vision | OCR Google Distributed Cloud (descontinuado) | Aplicação do Google Cloud Marketplace que pode ser implementada como um contentor em qualquer cluster do GKE através do GKE Enterprise. | Para cumprir os requisitos de residência ou conformidade dos dados. |

Deteção e extração

O Enterprise Document OCR pode detetar blocos, parágrafos, linhas, palavras e símbolos em PDFs e imagens, bem como corrigir a distorção dos documentos para uma maior precisão.

Atributos de deteção e extração de esquemas suportados:

| Texto impresso | Escrita manual | Parágrafo | Bloquear | Linha | Palavra | Ao nível do símbolo | Número da página |

|---|---|---|---|---|---|---|---|

| Predefinição | Predefinição | Predefinição | Predefinição | Predefinição | Predefinição | Configurável | Predefinição |

As funcionalidades configuráveis do Enterprise Document OCR incluem o seguinte:

Extraia texto incorporado ou nativo de PDFs digitais: esta funcionalidade extrai texto e símbolos exatamente como aparecem nos documentos de origem, mesmo para textos rodados, tamanhos ou estilos de letra extremos e texto parcialmente oculto.

Correção da rotação: use o OCR de documentos empresariais para pré-processar imagens de documentos de modo a corrigir problemas de rotação que podem afetar a qualidade da extração ou o processamento.

Classificação da qualidade da imagem: receba métricas de qualidade que podem ajudar no encaminhamento de documentos. A classificação da qualidade da imagem fornece-lhe métricas de qualidade ao nível da página em oito dimensões, incluindo o efeito de desfocagem, a presença de tipos de letra mais pequenos do que o habitual e o brilho excessivo.

Especificar intervalo de páginas: especifica o intervalo das páginas num documento de entrada para OCR. Isto poupa o tempo de processamento e os gastos em páginas desnecessárias.

Deteção de idiomas: deteta os idiomas usados nos textos extraídos.

Sugestões de idioma e caligrafia: melhore a precisão fornecendo ao modelo de OCR uma sugestão de idioma ou caligrafia com base nas caraterísticas conhecidas do seu conjunto de dados.

Para saber como ativar as configurações de OCR, consulte o artigo Ative as configurações de OCR.

Suplementos OCR

O Enterprise Document OCR oferece capacidades de análise opcionais que podem ser ativadas em pedidos de processamento individuais, conforme necessário.

As seguintes capacidades de suplementos estão disponíveis para as versões estável

pretrained-ocr-v2.0-2023-06-02 e pretrained-ocr-v2.1-2024-08-07,

e a versão Release Candidate pretrained-ocr-v2.1.1-2025-01-31.

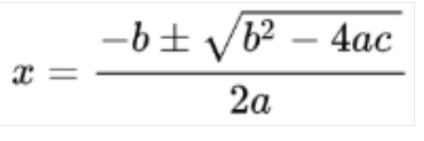

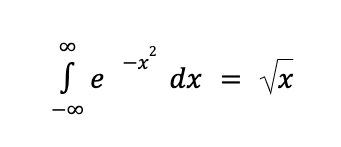

- OCR de matemática: identifique e extraia fórmulas de documentos no formato LaTeX.

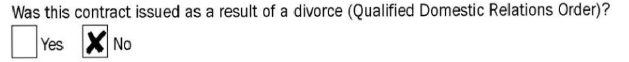

- Extração de caixas de verificação: detete caixas de verificação e extraia o respetivo estado (marcado/não marcado) na resposta do Enterprise Document OCR.

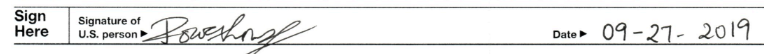

- Deteção do estilo do tipo de letra: identifique as propriedades do tipo de letra ao nível da palavra, incluindo o tipo de letra, o estilo do tipo de letra, a caligrafia, a espessura e a cor.

Para saber como ativar os suplementos indicados, consulte o artigo Ative suplementos de OCR.

Formatos de ficheiros suportados

O OCR de documentos empresariais suporta os formatos de ficheiro PDF, GIF, TIFF, JPEG, PNG, BMP e WebP. Para mais informações, consulte o artigo Ficheiros suportados.

O Enterprise Document OCR também suporta ficheiros DocX até 15 páginas em modo síncrono e 30 páginas em modo assíncrono. Para fazer um pedido de aumento da quota (QIR), siga os passos para pedir um ajuste da quota. O suporte de DocX está em pré-visualização privada. Para pedir acesso, contacte a equipa da sua Conta Google.

Controlo de versões avançado

O controlo de versões avançado está em pré-visualização. As atualizações aos modelos de OCR de IA/ML subjacentes podem levar a alterações no comportamento do OCR. Se for necessária uma consistência rigorosa, use uma versão do modelo congelada para fixar o comportamento a um modelo de OCR antigo durante um período máximo de 18 meses. Isto garante o mesmo resultado da função de OCR para a mesma imagem. Consulte a tabela sobre as versões do processador.

Versões do processador

As seguintes versões do processador são compatíveis com esta funcionalidade. Para mais informações, consulte o artigo Gerir versões do processador.

| ID da versão | Canal de lançamento | Descrição |

|---|---|---|

pretrained-ocr-v1.2-2022-11-10 |

Estável | Versão do modelo congelada da v1.0: ficheiros de modelo, configurações e binários de um resumo da versão congelado numa imagem de contentor durante um máximo de 18 meses. |

pretrained-ocr-v2.0-2023-06-02 |

Estável | Modelo pronto para produção especializado em exemplos de utilização de documentos. Inclui acesso a todos os suplementos de OCR. |

pretrained-ocr-v2.1-2024-08-07 |

Estável | As principais áreas de melhoria da v2.1 são: melhor reconhecimento de texto impresso, deteção mais precisa de caixas de verificação e ordem de leitura mais precisa. |

pretrained-ocr-v2.1.1-2025-01-31 |

Candidato a lançamento | A versão 2.1.1 é semelhante à versão 2.1 e está disponível em todas as regiões, exceto: US, EU e asia-southeast1. |

Use o Enterprise Document OCR para processar documentos

Este início rápido apresenta o Enterprise Document OCR. Mostra como otimizar os resultados de OCR de documentos para o seu fluxo de trabalho ativando ou desativando qualquer uma das configurações de OCR disponíveis.

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Document AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Document AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. quality/defect_blurryquality/defect_noisyquality/defect_darkquality/defect_faintquality/defect_text_too_smallquality/defect_document_cutoffquality/defect_text_cutoffquality/defect_glare- Pode devolver deteções de falsos positivos com documentos digitais sem defeitos. A funcionalidade é melhor usada em documentos digitalizados ou fotografados.

Os defeitos de reflexo são locais. A sua presença pode não prejudicar a legibilidade geral do documento.

- Para processar apenas a segunda e a quinta página:

- Para processar apenas as três primeiras páginas:

- Para processar apenas as últimas quatro páginas:

Imagem detetada

Conversão para LaTeX

- Deteção de escrita manual

- Estilo do tipo de letra

- Tamanho do tipo de letra

- Tipo de letra

- Cor do tipo de letra

- Espessura do tipo de letra

- Espaçamento entre letras

- Negrito

- Itálico

- Sublinhado

- Cor do texto (RGBa)

Cor de fundo (RGBa)

- A resposta da API Vision AI preenche apenas

verticespara pedidos de imagens e apenasnormalized_verticespara pedidos de PDF. A resposta da Document AI e o conversor preenchemverticesenormalized_vertices. - A resposta da API Vision AI preenche o

detected_breakno último símbolo da palavra. A resposta da API Document AI e o conversor preenchemdetected_breakna palavra e no último símbolo da palavra. - A resposta da API Vision AI preenche sempre os campos de símbolos. Por predefinição, a resposta da Document AI não preenche os campos de símbolos. Para garantir que a resposta da IA Documentos e o conversor preenchem os campos de símbolos, defina a funcionalidade

enable_symbolcomo detalhada. - LOCATION: a localização do seu processador, por exemplo:

us– Estados Unidoseu- União Europeia

- PROJECT_ID: o ID do seu Google Cloud projeto.

- PROCESSOR_ID: o ID do seu processador personalizado.

- PROCESSOR_VERSION: o identificador da versão do processador. Consulte o artigo Selecione uma versão do processador para mais informações. Por exemplo:

pretrained-TYPE-vX.X-YYYY-MM-DDstablerc

- skipHumanReview: um valor booleano para desativar a revisão humana (apenas suportado por processadores de interação humana).

true- ignora a revisão humanafalse: Ativa a revisão humana (predefinição)

- MIME_TYPE†: Uma das opções de tipo MIME válidas.

- IMAGE_CONTENT†: um dos seguintes conteúdos de documentos inline válidos, representados como um fluxo de bytes. Para representações JSON, a codificação base64 (string ASCII) dos dados de imagem binários. Esta string deve ser semelhante à

seguinte string:

/9j/4QAYRXhpZgAA...9tAVx/zDQDlGxn//2Q==

- FIELD_MASK: especifica os campos a incluir no resultado

Document. Esta é uma lista separada por vírgulas de nomes totalmente qualificados de campos no formatoFieldMask.- Exemplo:

text,entities,pages.pageNumber

- Exemplo:

- Configurações de OCR

- ENABLE_NATIVE_PDF_PARSING: (Booleano) Extrai texto incorporado de PDFs, se disponível.

- ENABLE_IMAGE_QUALITY_SCORES: (Booleano) Ativa as classificações de qualidade de documentos inteligentes.

- ENABLE_SYMBOL: (Booleano) Inclui informações de OCR de símbolos (letras).

- DISABLE_CHARACTER_BOXES_DETECTION: (Booleano) Desative o detetor de caixa de carateres no motor de OCR.

- LANGUAGE_HINTS: lista de códigos de idioma BCP-47 a usar para OCR.

- ADVANCED_OCR_OPTIONS: uma lista de opções avançadas de OCR para otimizar ainda mais o comportamento do OCR. Os valores válidos atuais são:

legacy_layout: um algoritmo de deteção de esquemas heurísticos, que serve como alternativa ao algoritmo de deteção de esquemas baseado na aprendizagem automática atual.

- Suplementos de OCR premium

- ENABLE_SELECTION_MARK_DETECTION: (Booleano) Ative o detetor de marcas de seleção no motor de OCR.

- COMPUTE_STYLE_INFO (Booleano) Ative o modelo de identificação de tipos de letra e devolva informações de estilo de tipo de letra.

- ENABLE_MATH_OCR: (Booleano) Ativar o modelo que pode extrair fórmulas matemáticas LaTeX.

- INDIVIDUAL_PAGES: uma lista de páginas individuais a processar.

- Reveja a lista de processadores.

- Separe os documentos em partes legíveis com o analisador de esquemas.

- Crie um classificador personalizado.

Crie um processador Enterprise Document OCR

Primeiro, crie um processador Enterprise Document OCR. Para mais informações, consulte o artigo sobre como criar e gerir processadores.

Configurações de OCR

Pode ativar todas as configurações de OCR definindo os campos respetivos em ProcessOptions.ocrConfig no ProcessDocumentRequest ou BatchProcessDocumentsRequest.

Para mais informações, consulte o artigo Envie um pedido de processamento.

Análise da qualidade da imagem

A análise inteligente da qualidade dos documentos usa a aprendizagem automática para realizar a avaliação da qualidade de um documento com base na legibilidade do respetivo conteúdo.

Esta avaliação de qualidade é devolvida como um índice de qualidade [0, 1], em que 1 significa qualidade perfeita.

Se o Índice de qualidade detetado for inferior a 0.5, também é devolvida uma lista de motivos de qualidade negativos (ordenados por probabilidade).

Uma probabilidade superior a 0.5 é considerada uma deteção positiva.

Se o documento for considerado defeituoso, a API devolve os seguintes oito tipos de defeitos de documentos:

Existem algumas limitações com a análise de qualidade de documentos atual:

Entrada

Ative-o definindo ProcessOptions.ocrConfig.enableImageQualityScores como true no pedido de processamento.

Esta funcionalidade adicional adiciona uma latência comparável ao processamento de OCR à chamada de processo.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableImageQualityScores": true

}

}

}

Resultado

Os resultados da deteção de defeitos são apresentados em Document.pages[].imageQualityScores[].

{

"pages": [

{

"imageQualityScores": {

"qualityScore": 0.7811847,

"detectedDefects": [

{

"type": "quality/defect_document_cutoff",

"confidence": 1.0

},

{

"type": "quality/defect_glare",

"confidence": 0.97849524

},

{

"type": "quality/defect_text_cutoff",

"confidence": 0.5

}

]

}

}

]

}

Consulte Exemplo de saída do processador para ver exemplos de saída completos.

Sugestões de idioma

O processador de OCR suporta sugestões de idiomas que define para melhorar o desempenho do motor de OCR. A aplicação de uma sugestão de idioma permite que o OCR seja otimizado para um idioma selecionado em vez de um idioma inferido.

Entrada

Ative-o definindo ProcessOptions.ocrConfig.hints[].languageHints[] com uma lista de códigos de idioma BCP-47.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"hints": {

"languageHints": ["en", "es"]

}

}

}

}

Consulte Exemplo de saída do processador para ver exemplos de saída completos.

Deteção de símbolos

Preencher dados ao nível do símbolo (ou da letra individual) na resposta do documento.

Entrada

Ative-o definindo ProcessOptions.ocrConfig.enableSymbol como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableSymbol": true

}

}

}

Resultado

Se esta funcionalidade estiver ativada, o campo Document.pages[].symbols[] é preenchido.

Consulte Exemplo de saída do processador para ver exemplos de saída completos.

Análise de PDFs incorporada

Extrair texto incorporado de ficheiros PDF digitais. Quando ativado, se existir texto digital, o modelo de PDF digital integrado é usado automaticamente. Se houver texto não digital, o modelo de OCR ótico é usado automaticamente. O utilizador recebe os resultados de texto e de imagem unidos.

Entrada

Ative-o definindo ProcessOptions.ocrConfig.enableNativePdfParsing como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableNativePdfParsing": true

}

}

}

Deteção de caracteres na caixa

Por predefinição, o OCR de documentos empresariais tem um detetor ativado para melhorar a qualidade da extração de texto de carateres que se encontram numa caixa. Vejamos um exemplo:

Se estiver a ter problemas de qualidade de OCR com carateres dentro de caixas, pode desativá-lo.

Entrada

Desative-o definindo ProcessOptions.ocrConfig.disableCharacterBoxesDetection como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"disableCharacterBoxesDetection": true

}

}

}

Esquema antigo

Se precisar de um algoritmo de deteção de esquemas heurístico, pode ativar o esquema antigo, que funciona como uma alternativa ao algoritmo de deteção de esquemas atual baseado em ML. Esta não é a configuração recomendada. Os clientes podem escolher o algoritmo de esquema mais adequado com base no fluxo de trabalho dos documentos.

Entrada

Ative-o definindo ProcessOptions.ocrConfig.advancedOcrOptions como ["legacy_layout"] no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"advancedOcrOptions": ["legacy_layout"]

}

}

}

Especifique um intervalo de páginas

Por predefinição, o OCR extrai texto e informações de esquema de todas as páginas nos documentos. Pode selecionar números de páginas ou intervalos de páginas específicos e extrair apenas texto dessas páginas.

Existem três formas de configurar esta opção no ProcessOptions:

{

"individualPageSelector": {"pages": [2, 5]}

}

{

"fromStart": 3

}

{

"fromEnd": 4

}

Na resposta, cada Document.pages[].pageNumber corresponde às mesmas páginas especificadas no pedido.

Usos dos suplementos de OCR

Estas capacidades de análise opcionais do Enterprise Document OCR podem ser ativadas em pedidos de processamento individuais, conforme necessário.

OCR matemático

O OCR de matemática deteta, reconhece e extrai fórmulas, como equações matemáticas representadas como LaTeX, juntamente com as coordenadas da caixa delimitadora.

Segue-se um exemplo de representação em LaTeX:

Entrada

Ative-o definindo ProcessOptions.ocrConfig.premiumFeatures.enableMathOcr como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"enableMathOcr": true

}

}

}

}

Resultado

O resultado do OCR de matemática é apresentado em Document.pages[].visualElements[] com "type": "math_formula".

"visualElements": [

{

"layout": {

"textAnchor": {

"textSegments": [

{

"endIndex": "46"

}

]

},

"confidence": 1,

"boundingPoly": {

"normalizedVertices": [

{

"x": 0.14662756,

"y": 0.27891156

},

{

"x": 0.9032258,

"y": 0.27891156

},

{

"x": 0.9032258,

"y": 0.8027211

},

{

"x": 0.14662756,

"y": 0.8027211

}

]

},

"orientation": "PAGE_UP"

},

"type": "math_formula"

}

]

Pode verificar o resultado JSON completo Document neste link .

Extração de marcas de seleção

Se estiver ativado, o modelo tenta extrair todas as caixas de verificação e botões de opção no documento, juntamente com as coordenadas da caixa delimitadora.

Entrada

Ative-o definindo ProcessOptions.ocrConfig.premiumFeatures.enableSelectionMarkDetection como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"enableSelectionMarkDetection": true

}

}

}

}

Resultado

O resultado da caixa de verificação é apresentado em Document.pages[].visualElements[] com "type": "unfilled_checkbox" ou "type": "filled_checkbox".

"visualElements": [

{

"layout": {

"confidence": 0.89363575,

"boundingPoly": {

"vertices": [

{

"x": 11,

"y": 24

},

{

"x": 37,

"y": 24

},

{

"x": 37,

"y": 56

},

{

"x": 11,

"y": 56

}

],

"normalizedVertices": [

{

"x": 0.017488075,

"y": 0.38709676

},

{

"x": 0.05882353,

"y": 0.38709676

},

{

"x": 0.05882353,

"y": 0.9032258

},

{

"x": 0.017488075,

"y": 0.9032258

}

]

}

},

"type": "unfilled_checkbox"

},

{

"layout": {

"confidence": 0.9148201,

"boundingPoly": ...

},

"type": "filled_checkbox"

}

],

Pode verificar o resultado JSON completo Document neste link .

Deteção de estilo do tipo de letra

Com a deteção de estilo de tipo de letra ativada, o Enterprise Document OCR extrai atributos de tipo de letra, que podem ser usados para um melhor pós-processamento.

Ao nível do token (palavra), são detetados os seguintes atributos:

Entrada

Ative-o definindo ProcessOptions.ocrConfig.premiumFeatures.computeStyleInfo como true no pedido de processamento.

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"computeStyleInfo": true

}

}

}

}

Resultado

O resultado de font-style é apresentado em Document.pages[].tokens[].styleInfo com o tipo StyleInfo.

"tokens": [

{

"styleInfo": {

"fontSize": 3,

"pixelFontSize": 13,

"fontType": "SANS_SERIF",

"bold": true,

"fontWeight": 564,

"textColor": {

"red": 0.16862746,

"green": 0.16862746,

"blue": 0.16862746

},

"backgroundColor": {

"red": 0.98039216,

"green": 0.9882353,

"blue": 0.99215686

}

}

},

...

]

Pode verificar o resultado JSON completo Document neste link .

Converta objetos de documentos para o formato da API Vision AI

A Document AI Toolbox inclui uma ferramenta que converte o formato Document da API Document AI no formato AnnotateFileResponse da Vision AI, o que permite aos utilizadores comparar as respostas entre o processador de OCR de documentos e a API Vision AI. Segue-se um exemplo de código.

Discrepâncias conhecidas entre a resposta da API Vision AI e a resposta da API Document AI e do conversor:

Exemplos de código

Os exemplos de código seguintes demonstram como enviar um pedido de processamento que ativa as configurações de OCR e os suplementos, e, em seguida, lê e imprime os campos no terminal:

REST

Antes de usar qualquer um dos dados do pedido, faça as seguintes substituições:

† Também pode especificar este conteúdo através de conteúdo codificado em base64 no objeto inlineDocument.

Método HTTP e URL:

POST https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process

Corpo JSON do pedido:

{

"skipHumanReview": skipHumanReview,

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"fieldMask": "FIELD_MASK",

"processOptions": {

"ocrConfig": {

"enableNativePdfParsing": ENABLE_NATIVE_PDF_PARSING,

"enableImageQualityScores": ENABLE_IMAGE_QUALITY_SCORES,

"enableSymbol": ENABLE_SYMBOL,

"disableCharacterBoxesDetection": DISABLE_CHARACTER_BOXES_DETECTION,

"hints": {

"languageHints": [

"LANGUAGE_HINTS"

]

},

"advancedOcrOptions": ["ADVANCED_OCR_OPTIONS"],

"premiumFeatures": {

"enableSelectionMarkDetection": ENABLE_SELECTION_MARK_DETECTION,

"computeStyleInfo": COMPUTE_STYLE_INFO,

"enableMathOcr": ENABLE_MATH_OCR,

}

},

"individualPageSelector" {

"pages": [INDIVIDUAL_PAGES]

}

}

}

Para enviar o seu pedido, escolha uma destas opções:

curl

Guarde o corpo do pedido num ficheiro com o nome request.json,

e execute o seguinte comando:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process"

PowerShell

Guarde o corpo do pedido num ficheiro com o nome request.json,

e execute o seguinte comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process" | Select-Object -Expand Content

Se o pedido for bem-sucedido, o servidor devolve um código de estado HTTP 200 OK e a resposta no formato JSON. O corpo da resposta contém uma instância de

Document.

Python

Para mais informações, consulte a documentação de referência da API Python Document AI.

Para se autenticar no Document AI, configure as Credenciais padrão da aplicação. Para mais informações, consulte o artigo Configure a autenticação para um ambiente de desenvolvimento local.