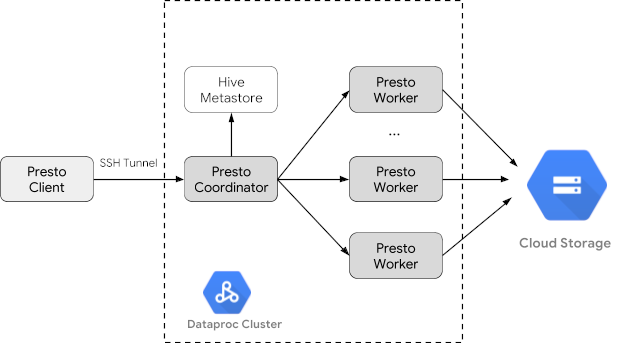

Trino (antes Presto) es un motor de consulta en SQL distribuido diseñado para consultar grandes conjuntos de datos distribuidos en una o más fuentes de datos heterogéneas. Trino puede consultar Hive, MySQL, Kafka y otras fuentes de datos a través de conectores. En este instructivo, se muestra cómo hacer lo siguiente:

- Instala el servicio de Trino en un clúster de Managed Service para Apache Spark

- Consultar datos públicos de un cliente de Trino instalado en tu máquina local que se comunique con un servicio de Trino en tu clúster

- Ejecutar consultas desde una aplicación Java que se comunique con el servicio Trino en tu clúster a través del controlador JDBC de Java de Trino

Objetivos

- Extraer los datos de BigQuery

- Cargar los datos en Cloud Storage como archivos CSV

- Transformar los datos:

- Exponer los datos como una tabla externa de Hive para que Trino pueda consultarlos

- Convertir los datos del formato CSV al formato Parquet para que las consultas sean más rápidas

Costos

En este documento, usarás los siguientes componentes facturables de Google Cloud:

Para generar una estimación de costos en función del uso previsto,

usa la calculadora de precios.

Antes de comenzar

Si aún no lo hiciste, crea un Google Cloud proyecto y un bucket de Cloud Storage para conservar los datos que se usan en este instructivo. 1. Configura tu proyecto- Accede a tu cuenta de Google Cloud . Si eres nuevo en Google Cloud, crea una cuenta para evaluar el rendimiento de nuestros productos en situaciones reales. Los clientes nuevos también obtienen $300 en créditos gratuitos para ejecutar, probar y, además, implementar cargas de trabajo.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc, Compute Engine, Cloud Storage, and BigQuery APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Instala Google Cloud CLI.

-

Si usas un proveedor de identidad externo (IdP), primero debes acceder a la gcloud CLI con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc, Compute Engine, Cloud Storage, and BigQuery APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

Instala Google Cloud CLI.

-

Si usas un proveedor de identidad externo (IdP), primero debes acceder a la gcloud CLI con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init

- En la consola de Google Cloud , ve a la página Buckets de Cloud Storage.

- Haz clic en Crear.

- En la página Crear un bucket, ingresa la información de tu bucket. Para ir al paso siguiente, haz clic en Continuar.

-

En la sección Primeros pasos, haz lo siguiente:

- Ingresa un nombre único a nivel global que cumpla con los requisitos de nombre de los buckets.

- Para agregar una

etiqueta de bucket,

expande la sección Etiquetas (),

haz clic en add_box

Agregar etiqueta y especifica una

keyy unvaluepara tu etiqueta.

-

En la sección Elige dónde almacenar tus datos, haz lo siguiente:

- Selecciona un tipo de ubicación

- Elige una ubicación en la que se almacenen de forma permanente los datos de tu bucket en el menú desplegable Tipo de ubicación.

- Si seleccionas el tipo de ubicación birregional, también puedes habilitar la replicación turbo con la casilla de verificación correspondiente.

- Para configurar la replicación bucket buckets, selecciona

Agregar replicación entre bucket a través del Servicio de transferencia de almacenamiento y

sigue estos pasos:

Configura la replicación entre buckets

- En el menú Bucket, selecciona un bucket.

En la sección Configuración de replicación, haz clic en Configurar para configurar los parámetros del trabajo de replicación.

Aparecerá el panel Configurar la replicación entre buckets.

- Para filtrar los objetos que se replicarán por prefijo de nombre de objeto, ingresa un prefijo con el que quieras incluir o excluir objetos y, luego, haz clic en Agregar un prefijo.

- Para establecer una clase de almacenamiento para los objetos replicados, selecciona una clase de almacenamiento en el menú Clase de almacenamiento. Si omites este paso, los objetos replicados usarán la clase de almacenamiento del bucket de destino de forma predeterminada.

- Haz clic en Listo.

-

En la sección Elige cómo almacenar tus datos, haz lo siguiente:

- Selecciona una clase de almacenamiento predeterminada para el bucket o Autoclass para la administración automática de clases de almacenamiento de los datos de tu bucket.

- Para habilitar el espacio de nombres jerárquico, en la sección Optimizar el almacenamiento para cargas de trabajo con uso intensivo de datos, selecciona Habilitar el espacio de nombres jerárquico en este bucket.

- En la sección Elige cómo controlar el acceso a los objetos, selecciona si tu bucket aplica o no la prevención del acceso público y elige un método de control de acceso para los objetos del bucket.

-

En la sección Elige cómo proteger los datos de objetos, haz lo siguiente:

- Selecciona cualquiera de las opciones de Protección de datos que

desees configurar para tu bucket.

- Para habilitar la eliminación no definitiva, haz clic en la casilla de verificación Política de eliminación no definitiva (para la recuperación de datos) y especifica la cantidad de días que deseas conservar los objetos después de la eliminación.

- Para configurar el control de versiones de objetos, haz clic en la casilla de verificación Control de versiones de objetos (para el control de versión) y especifica la cantidad máxima de versiones por objeto y la cantidad de días después de los cuales vencen las versiones no actuales.

- Para habilitar la política de retención en objetos y buckets, haz clic en la casilla de verificación Retención (para cumplimiento) y, luego, haz lo siguiente:

- Para habilitar el bloqueo de retención de objetos, haz clic en la casilla de verificación Habilitar la retención de objetos.

- Para habilitar el Bloqueo del bucket, haz clic en la casilla de verificación Establecer política de retención del bucket y elige una unidad de tiempo y una duración para tu período de retención.

- Para elegir cómo se encriptarán los datos de tus objetos, expande la sección Encriptación de datos () y selecciona un método de encriptación de datos.

- Selecciona cualquiera de las opciones de Protección de datos que

desees configurar para tu bucket.

-

En la sección Primeros pasos, haz lo siguiente:

- Haz clic en Crear.

Crea un clúster de Managed Service para Apache Spark

Crea un clúster de Managed Service para Apache Spark con la marca optional-components (disponible en la versión 2.1 y posteriores de la imagen) para instalar el componente opcional de Trino en el clúster y la marca enable-component-gateway para habilitar la Puerta de enlace del componente y permitirte acceder a la IU web de Trino desde la consola de Google Cloud .

- Configura las variables de entorno:

- PROJECT: El ID de tu proyecto

- BUCKET_NAME: El nombre del depósito de Cloud Storage que creaste en la sección Antes de comenzar

- REGION: La región donde se creará el clúster que se usa en este instructivo, por ejemplo, "us-west1"

- WORKERS: Se recomienda usar entre 3 y 5 trabajadores para las actividades de este instructivo.

export PROJECT=project-id export WORKERS=number export REGION=region export BUCKET_NAME=bucket-name

- Ejecuta Google Cloud CLI en tu máquina local para crear el clúster.

gcloud beta dataproc clusters create trino-cluster \ --project=${PROJECT} \ --region=${REGION} \ --num-workers=${WORKERS} \ --scopes=cloud-platform \ --optional-components=TRINO \ --image-version=2.1 \ --enable-component-gateway

Preparar los datos

Exporta el conjunto de datos chicago_taxi_trips de bigquery-public-data a Cloud Storage como archivos CSV y, luego, crea una tabla externa de Hive para hacer referencia a los datos.

- Ejecuta el siguiente comando en tu máquina local para importar los datos de taxis de BigQuery como archivos CSV sin encabezados al depósito de Cloud Storage que creaste en la sección Antes de comenzar.

bq --location=us extract --destination_format=CSV \ --field_delimiter=',' --print_header=false \ "bigquery-public-data:chicago_taxi_trips.taxi_trips" \ gs://${BUCKET_NAME}/chicago_taxi_trips/csv/shard-*.csv - Crea tablas externas de Hive que estén respaldadas por los archivos CSV y Parquet de tu depósito de Cloud Storage.

- Crea la tabla externa de Hive

chicago_taxi_trips_csv.gcloud dataproc jobs submit hive \ --cluster trino-cluster \ --region=${REGION} \ --execute " CREATE EXTERNAL TABLE chicago_taxi_trips_csv( unique_key STRING, taxi_id STRING, trip_start_timestamp TIMESTAMP, trip_end_timestamp TIMESTAMP, trip_seconds INT, trip_miles FLOAT, pickup_census_tract INT, dropoff_census_tract INT, pickup_community_area INT, dropoff_community_area INT, fare FLOAT, tips FLOAT, tolls FLOAT, extras FLOAT, trip_total FLOAT, payment_type STRING, company STRING, pickup_latitude FLOAT, pickup_longitude FLOAT, pickup_location STRING, dropoff_latitude FLOAT, dropoff_longitude FLOAT, dropoff_location STRING) ROW FORMAT DELIMITED FIELDS TERMINATED BY ',' STORED AS TEXTFILE location 'gs://${BUCKET_NAME}/chicago_taxi_trips/csv/';" - Verifica la creación de la tabla externa de Hive.

gcloud dataproc jobs submit hive \ --cluster trino-cluster \ --region=${REGION} \ --execute "SELECT COUNT(*) FROM chicago_taxi_trips_csv;" - Crea otro

chicago_taxi_trips_parquetde tabla externa de Hive con las mismas columnas, pero con datos almacenados en formato Parquet para mejorar el rendimiento de las consultas.gcloud dataproc jobs submit hive \ --cluster trino-cluster \ --region=${REGION} \ --execute " CREATE EXTERNAL TABLE chicago_taxi_trips_parquet( unique_key STRING, taxi_id STRING, trip_start_timestamp TIMESTAMP, trip_end_timestamp TIMESTAMP, trip_seconds INT, trip_miles FLOAT, pickup_census_tract INT, dropoff_census_tract INT, pickup_community_area INT, dropoff_community_area INT, fare FLOAT, tips FLOAT, tolls FLOAT, extras FLOAT, trip_total FLOAT, payment_type STRING, company STRING, pickup_latitude FLOAT, pickup_longitude FLOAT, pickup_location STRING, dropoff_latitude FLOAT, dropoff_longitude FLOAT, dropoff_location STRING) STORED AS PARQUET location 'gs://${BUCKET_NAME}/chicago_taxi_trips/parquet/';" - Carga los datos de la tabla CSV de Hive en la tabla de Parquet de Hive.

gcloud dataproc jobs submit hive \ --cluster trino-cluster \ --region=${REGION} \ --execute " INSERT OVERWRITE TABLE chicago_taxi_trips_parquet SELECT * FROM chicago_taxi_trips_csv;" - Verifica que los datos se hayan cargado correctamente.

gcloud dataproc jobs submit hive \ --cluster trino-cluster \ --region=${REGION} \ --execute "SELECT COUNT(*) FROM chicago_taxi_trips_parquet;"

- Crea la tabla externa de Hive

Ejecuta consultas

Puedes ejecutar consultas de forma local desde la CLI de Trino o desde una aplicación.

Consultas de la CLI de Trino

En esta sección, se muestra cómo consultar el conjunto de datos de taxis de Parquet de Hive con la CLI de Trino.

- Ejecuta el siguiente comando en tu máquina local para establecer una conexión SSH al nodo principal del clúster. La terminal local dejará de responder durante la ejecución del comando.

gcloud compute ssh trino-cluster-m

- En la ventana de la terminal de SSH del nodo principal de tu clúster, ejecuta la CLI de Trino, que se conecta al servidor de Trino que se ejecuta en el nodo principal.

trino --catalog hive --schema default

- Cuando aparezca el mensaje

trino:default, verifica que Trino pueda encontrar las tablas de Hive.show tables;

Table ‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐‐ chicago_taxi_trips_csv chicago_taxi_trips_parquet (2 rows)

- Ejecuta consultas desde el mensaje

trino:defaulty compara el rendimiento de las consultas de datos Parquet y las consultas de datos CSV.- Consulta de datos Parquet

select count(*) from chicago_taxi_trips_parquet where trip_miles > 50;

_col0 ‐‐‐‐‐‐‐‐ 117957 (1 row)

Query 20180928_171735_00006_2sz8c, FINISHED, 3 nodes Splits: 308 total, 308 done (100.00%) 0:16 [113M rows, 297MB] [6.91M rows/s, 18.2MB/s] - Consulta de datos CSV

select count(*) from chicago_taxi_trips_csv where trip_miles > 50;

_col0 ‐‐‐‐‐‐‐‐ 117957 (1 row)

Query 20180928_171936_00009_2sz8c, FINISHED, 3 nodes Splits: 881 total, 881 done (100.00%) 0:47 [113M rows, 41.5GB] [2.42M rows/s, 911MB/s]

- Consulta de datos Parquet

Consultas de aplicaciones Java

Para ejecutar consultas desde una aplicación Java a través del controlador JDBC de Java de Trino, sigue estos pasos:

1. Descarga el controlador JDBC de Java de Trino.

1. Agrega una dependencia trino-jdbc en Maven pom.xml.

<dependency> <groupId>io.trino</groupId> <artifactId>trino-jdbc</artifactId> <version>376</version> </dependency>

package dataproc.codelab.trino;

import java.sql.Connection;

import java.sql.DriverManager;

import java.sql.ResultSet;

import java.sql.SQLException;

import java.sql.Statement;

import java.util.Properties;

public class TrinoQuery {

private static final String URL = "jdbc:trino://trino-cluster-m:8080/hive/default";

private static final String SOCKS_PROXY = "localhost:1080";

private static final String USER = "user";

private static final String QUERY =

"select count(*) as count from chicago_taxi_trips_parquet where trip_miles > 50";

public static void main(String[] args) {

try {

Properties properties = new Properties();

properties.setProperty("user", USER);

properties.setProperty("socksProxy", SOCKS_PROXY);

Connection connection = DriverManager.getConnection(URL, properties);

try (Statement stmt = connection.createStatement()) {

ResultSet rs = stmt.executeQuery(QUERY);

while (rs.next()) {

int count = rs.getInt("count");

System.out.println("The number of long trips: " + count);

}

}

} catch (SQLException e) {

e.printStackTrace();

}

}

}Registro y supervisión

Logging

Los registros de Trino se encuentran en /var/log/trino/, en los nodos principales y trabajadores del clúster.

IU web

Consulta Visualiza las URLs de la puerta de enlace de componentes y accede a ellas para abrir la IU web de Trino que se ejecuta en el nodo principal del clúster en tu navegador local.

Supervisión

Trino expone la información de tiempo de ejecución del clúster a través de tablas de tiempo de ejecución.

En una sesión de Trino (desde el símbolo del sistema trino:default), ejecuta la siguiente consulta para ver los datos de la tabla del entorno de ejecución:

select * FROM system.runtime.nodes;

Realiza una limpieza

Una vez que completes el instructivo, puedes limpiar los recursos que creaste para que dejen de usar la cuota y generar cargos. En las siguientes secciones, se describe cómo borrar o desactivar estos recursos.

Borra el proyecto

La manera más fácil de eliminar la facturación es borrar el proyecto que creaste para el instructivo.

Para borrar el proyecto, sigue estos pasos:

- En la Google Cloud consola, ve a la página Administrar recursos.

- En la lista de proyectos, elige el proyecto que quieres borrar y haz clic en Borrar.

- En el diálogo, escribe el ID del proyecto y, luego, haz clic en Cerrar para borrar el proyecto.

Borra el clúster

- Para borrar tu clúster, realiza los siguientes pasos:

gcloud dataproc clusters delete --project=${PROJECT} trino-cluster \ --region=${REGION}

Borra el bucket

- Para borrar el depósito de Cloud Storage que creaste en la sección Antes de comenzar, incluidos los archivos de datos almacenados en el depósito, ejecuta lo siguiente:

gcloud storage rm gs://${BUCKET_NAME} --recursive