Cluster mit Clientbibliotheken erstellen

Der unten aufgeführte Beispielcode zeigt Ihnen, wie Sie mit den Cloud-Clientbibliotheken einen Managed Service for Apache Spark-Cluster erstellen, einen Job im Cluster ausführen und anschließend den Cluster löschen.

Sie können die Aufgaben auch hiermit ausführen:

- API REST-Anfragen in Kurzanleitung: API Explorer verwenden

- die Google Cloud console in Cluster mit der Google Cloud console erstellen

- die Google Cloud CLI in Cluster mit der Google Cloud CLI erstellen

Hinweis

- Melden Sie sich in Ihrem Google Cloud -Konto an. Wenn Sie noch nicht mit Google Cloudvertraut sind, erstellen Sie ein Konto, um die Leistung unserer Produkte in der Praxis sehen und bewerten zu können. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator role

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

Enable the Dataproc API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Code ausführen

Schritt-für-Schritt-Anleitung ausprobieren: Klicken Sie auf In Cloud Shell öffnen , um eine Python-Schritt-für-Schritt-Anleitung für die Cloud-Clientbibliotheken auszuführen, mit der ein Cluster erstellt, ein PySpark-Job ausgeführt und der Cluster anschließend gelöscht wird.

Go

- Installieren Sie die Clientbibliothek Weitere Informationen finden Sie unter Entwicklungsumgebung einrichten.

- Authentifizierung einrichten

- Klonen Sie GitHub-Beispielcode und führen Sie ihn aus.

Java

- Installieren Sie die Clientbibliothek Weitere Informationen finden Sie unter Java-Entwicklungsumgebung einrichten.

- Authentifizierung einrichten

- Klonen Sie GitHub-Beispielcode und führen Sie ihn aus.

Node.js

- Installieren Sie die Clientbibliothek Weitere Informationen finden Sie unter Node.js-Entwicklungsumgebung einrichten.

- Authentifizierung einrichten

- Klonen Sie GitHub-Beispielcode und führen Sie ihn aus.

Python

- Installieren Sie die Clientbibliothek Weitere Informationen finden Sie unter Python-Entwicklungsumgebung einrichten.

- Authentifizierung einrichten

- Klonen Sie GitHub-Beispielcode und führen Sie ihn aus.

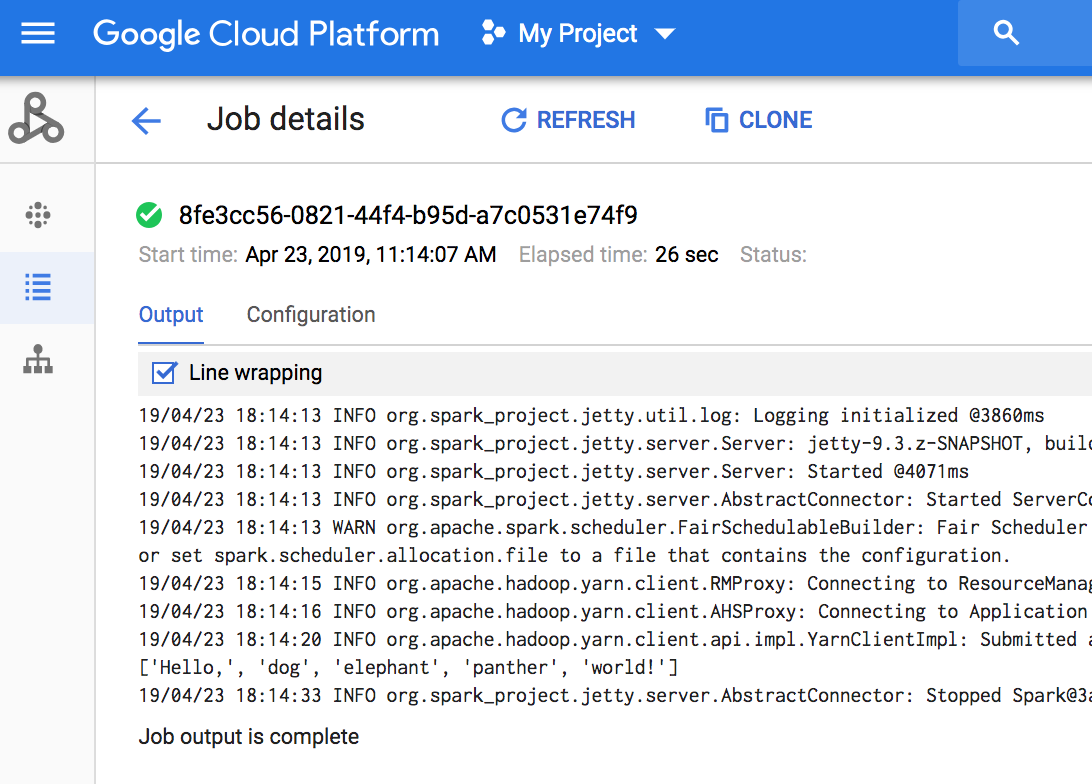

Ausgabe ansehen

Der Code gibt das Jobtreiberlog an den standardmäßigen Managed Service for Apache Spark Staging-Bucket in Cloud Storage aus. Sie können die Jobtreiberausgabe in der Google Cloud console in Ihrem Projekt auf der Seite Jobs von Managed Service for Apache Spark in der Google Cloud console aufrufen. Klicken Sie auf die Job-ID, um die Jobausgabe auf der Seite Jobdetails anzuzeigen.

Nächste Schritte

- Weitere Informationen finden Sie in der Cloud-Clientbibliothek für Managed Service for Apache Spark unter Zusätzliche Ressourcen.