Paso 6: Ejecuta la implementación

En esta página, se describe el sexto paso para implementar Cortex Framework Data Foundation, el núcleo de Cortex Framework. En este paso, ejecutarás la implementación de Cortex Framework Data Foundation.

Proceso de compilación

Después de configurar el config.json

archivo como se describe en el Paso 5: Configura la implementación,

sigue estas instrucciones para compilar tu proceso.

Ejecuta el siguiente comando para ubicarte en el repositorio clonado:

cd cortex-data-foundationEjecuta el comando de compilación con el bucket de registros de destino:

gcloud builds submit \ --substitutions=_GCS_BUCKET=LOGS_BUCKET_NAME,_BUILD_ACCOUNT='projects/SOURCE_PROJECT/serviceAccounts/CLOUD_BUILD_SA@SOURCE_PROJECT.iam.gserviceaccount.com'Reemplaza lo siguiente:

LOGS_BUCKET_NAMEpor el nombre del bucket para el almacenamiento de registros. La cuenta de servicio de Cloud Build necesita acceso para escribirlos aquí.SOURCE_PROJECTpor el proyecto de origen.CLOUD_BUILD_SApor el ID de cuenta del servicio de Cloud Build creada en el paso 4 de la implementación.

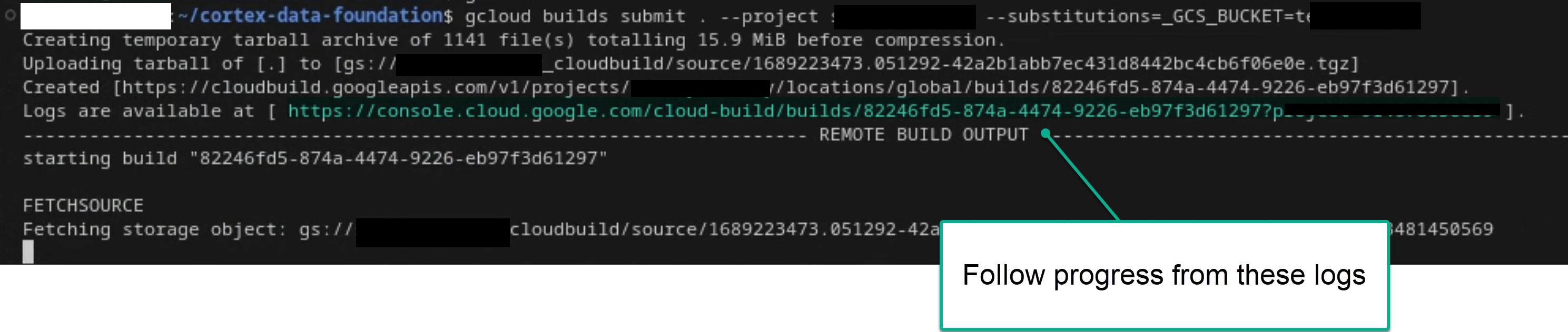

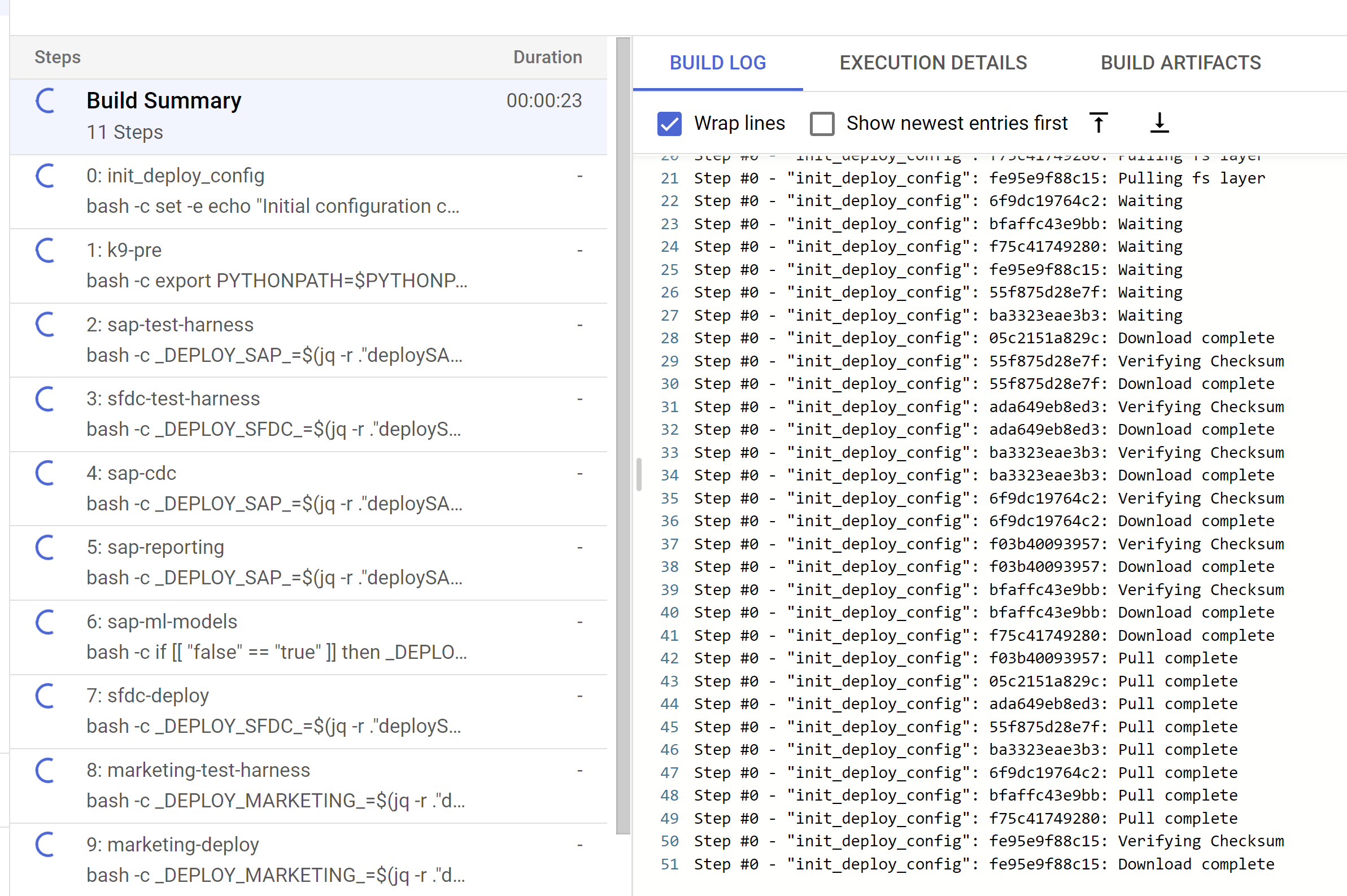

Sigue el proceso de compilación principal mirando los registros en la terminal o en la consola de Cloud Build, si tienes suficientes permisos. Consulta las siguientes imágenes para obtener más información.

Figura 1. Ejemplo de cómo ver el progreso de los registros en la terminal

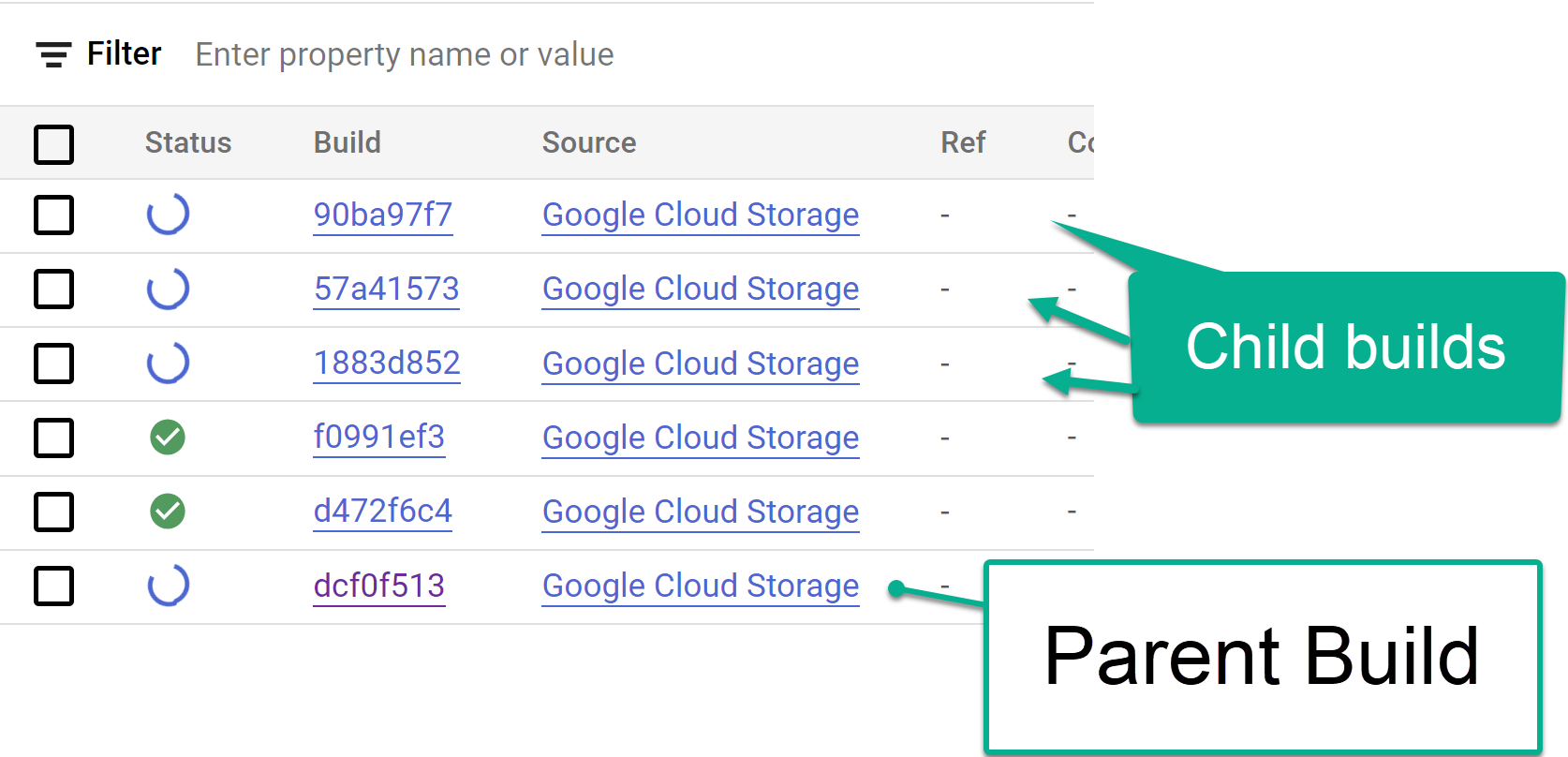

Figura 2. Ejemplo de cómo ver el progreso de los registros en la consola Haz un seguimiento de los pasos de compilación secundarios activados desde la consola de Cloud Build o dentro de los registros creados a partir de los pasos. Consulta las siguientes imágenes para obtener más información.

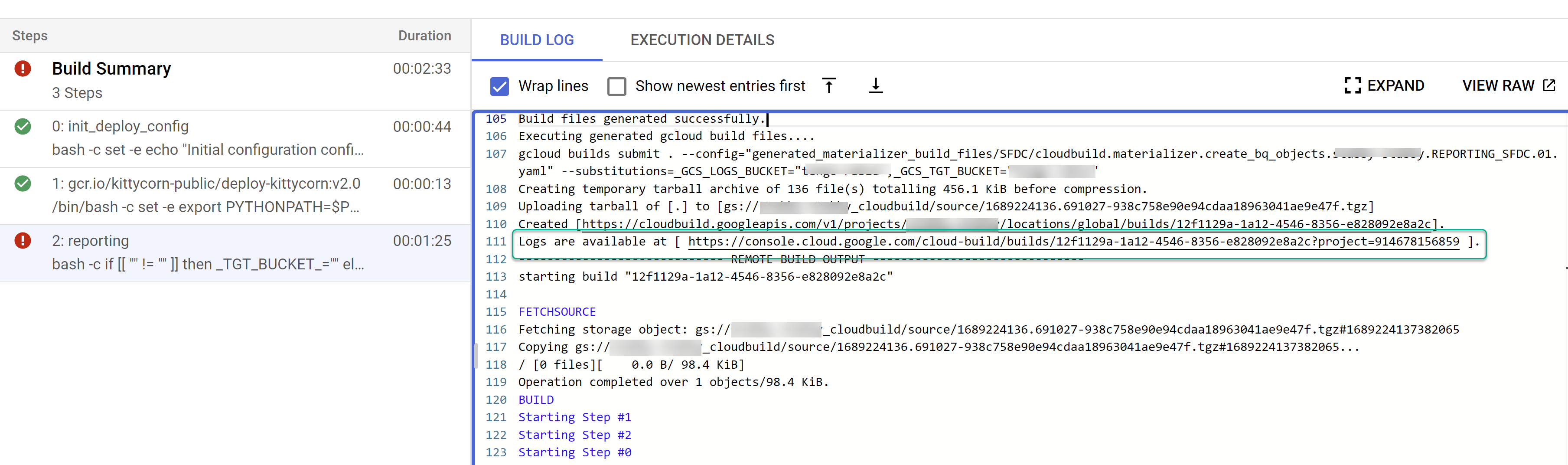

Figura 3. Ejemplo de seguimiento de pasos de compilación secundarios en la consola

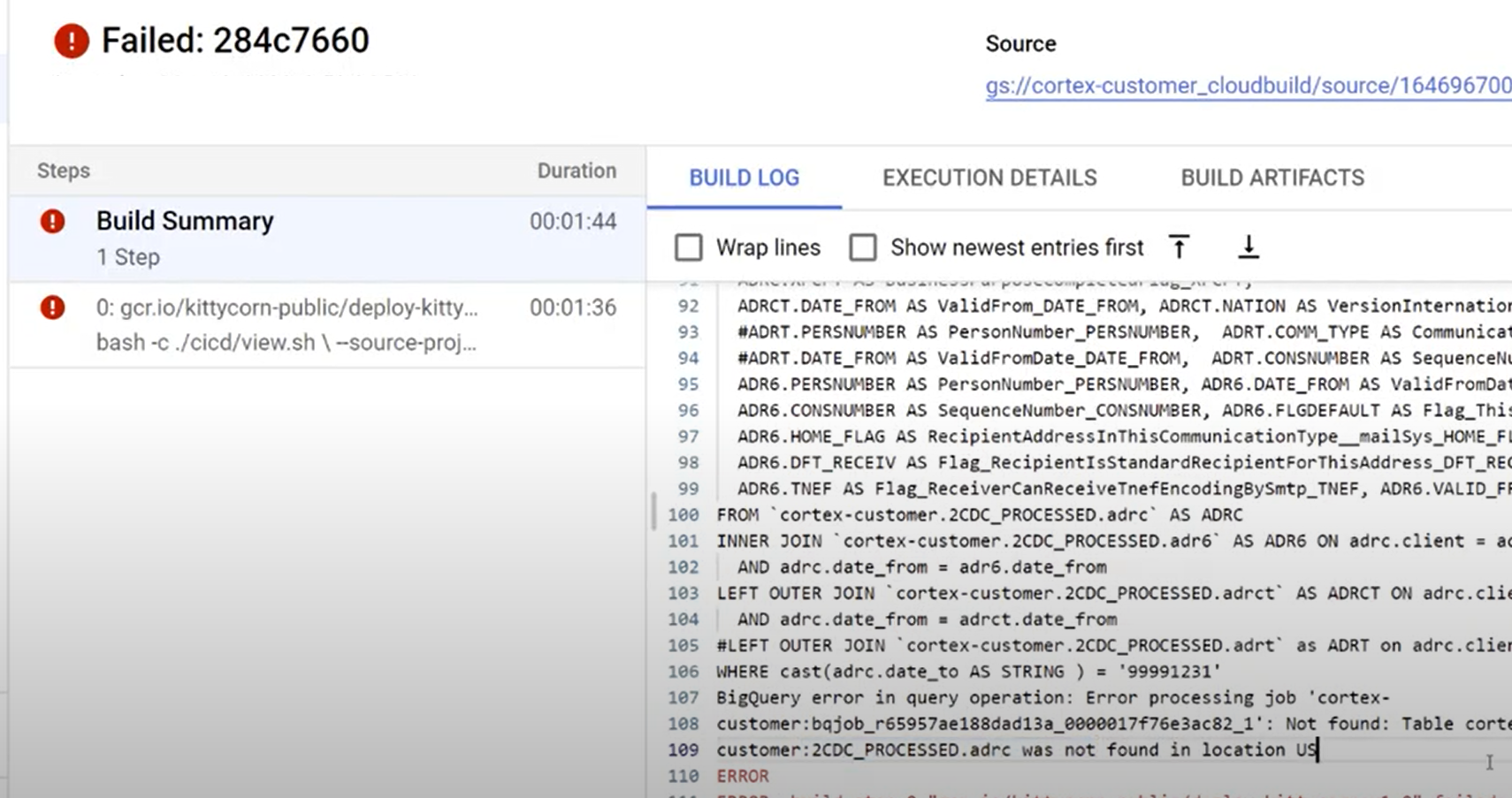

Figura 4. Ejemplo de seguimiento de pasos de compilación secundarios dentro de los registros Identifica cualquier problema con las compilaciones individuales. Corrige los errores, si los hay. Se recomienda pegar el SQL generado en BigQuery para identificar y corregir los errores. La mayoría de los errores están relacionados con campos que se seleccionan, pero que no están presentes en la fuente replicada. La IU de BigQuery ayuda a identificarlos y comentarlos.

Figura 5. Ejemplo de identificación de problemas a través de los registros de Cloud Build

Mueve archivos al bucket de DAG de Managed Service para Apache Airflow (Airflow)

Si elegiste generar archivos de integración o CDC y tienes una instancia de Managed Airflow (Airflow), puedes moverlos a su bucket final con el siguiente comando:

gcloud storage -m cp -r gs://OUTPUT_BUCKET/dags/ gs://COMPOSER_DAG_BUCKET/

gcloud storage -m cp -r gs://OUTPUT_BUCKET/data/ gs://COMPOSER_DAG_BUCKET/

Reemplaza lo siguiente:

OUTPUT_BUCKETpor el bucket de salida.COMPOSER_DAG_BUCKETpor el bucket de DAG de Managed Airflow (Airflow).

Personaliza y prepárate para la actualización

Muchos clientes empresariales tienen personalizaciones específicas de sus sistemas, como documentos adicionales en un flujo o tipos específicos de un registro. Estos son específicos para cada cliente y los analistas funcionales los configuran a medida que surgen las necesidades comerciales.

Cortex utiliza etiquetas ## CORTEX-CUSTOMER en el código para indicar lugares donde es probable que se requieran esas personalizaciones. Usa el comando grep -R CORTEX-CUSTOMER para verificar todos los comentarios ## CORTEX-CUSTOMER que debes personalizar.

Además de las etiquetas CORTEX-CUSTOMER, es posible que debas personalizar aún más lo siguiente. Para ello, confirma todos estos cambios con una etiqueta clara en el código de tu propio repositorio bifurcado o clonado:

- Agregar reglas comerciales

- Agregar otros conjuntos de datos y unirlos con vistas o tablas existentes

- Reutilizar las plantillas proporcionadas para llamar a APIs adicionales

- Modificar secuencias de comandos de implementación

- Adaptar algunas tablas o APIs de destino para incluir campos adicionales que no se incluyen en el estándar

Adopta una canalización de CI/CD que funcione para tu organización para mantener estas mejoras probadas y tu solución general en un estado confiable y sólido. Una canalización puede reutilizar las cloudbuild.yaml

secuencias de comandos para activar la implementación de extremo a extremo de forma periódica o según las

operaciones de Git, según el repositorio que elijas mediante la

automatización de compilaciones.

Usa el archivo config.json para definir diferentes conjuntos de proyectos y conjuntos de datos para entornos de desarrollo, pruebas y producción. Usa pruebas automatizadas con tus propios datos de muestra para asegurarte de que los modelos siempre produzcan lo que esperas.

Etiquetar tus propios cambios de forma visible en tu bifurcación o clon de un repositorio junto con la automatización de algunas pruebas y la implementación ayuda a realizar actualizaciones.

Asistencia

Si tienes algún problema o solicitud de funciones relacionados con estos modelos

o implementadores, crea un problema en el repositorio de Cortex Framework Data Foundation. Para ayudarte a recopilar la información necesaria, ejecuta support.sh desde el directorio clonado. Esta secuencia de comandos te guía a través de una serie de pasos para ayudarte a solucionar problemas.

Si tienes solicitudes o problemas de Cortex Framework, ve a la sección de asistencia en la página de descripción general.

Bloques y paneles de Looker

Aprovecha los bloques y paneles de Looker disponibles. Estos son, básicamente, modelos de datos reutilizables para patrones analíticos comunes y fuentes de datos para Cortex Framework. Para obtener más información, consulta Descripción general de los bloques y paneles de Looker.