第 3 步:确定集成机制

本页介绍了部署 Cortex Framework Data Foundation(Cortex Framework 的核心)的第三步。在此步骤中,您需要配置与所选数据源的集成。如果您使用的是示例数据,请跳过此步骤 。

集成概览

Cortex Framework 可帮助您集中来自各种来源的数据以及其他平台的数据。这样可以为您的数据创建单一可信来源。Cortex Data Foundation 以不同的方式与每个数据源集成,但大多数集成都遵循类似的过程:

- 从来源到原始层 :使用 API 将数据从数据源注入到原始数据集。这是通过使用由 Managed Airflow DAG 触发的 Dataflow 流水线实现的。

- 从原始层到 CDC 层:对原始数据集应用 CDC 处理,并将输出存储在 CDC 数据集中。这是通过运行 BigQuery SQL 的 Managed Airflow DAG 实现的。

- 从 CDC 层到报告层 :从报告数据集中的 CDC 表创建最终报告表。这是通过在 CDC 表之上创建运行时视图或运行 Managed Airflow DAG 以获取 BigQuery 表中的具体化数据来实现的,具体取决于配置方式。 如需详细了解配置,请参阅自定义报告设置文件。

config.json 文件用于配置连接到数据

源所需的设置,以便从各种工作负载传输数据。如需了解每个数据源的集成选项,请参阅以下资源。

- 运营:

- 营销:

- 可持续性:

如需详细了解每个

数据源支持的实体关系图,请参阅 Cortex Framework Data Foundation 代码库中的 docs 文件夹。

K9 部署

K9 部署程序 简化了各种数据源的集成。K9 部署程序是 BigQuery 环境中的预定义数据集,负责注入、处理和建模可在不同数据源中重复使用的组件。

例如,time 维度可在所有数据源中重复使用,在这些数据源中,表可能需要根据公历获取分析结果。K9 部署程序将天气或 Google 趋势等外部数据与其他数据源(例如 SAP、Salesforce、Marketing)相结合。这种丰富的数据集可以提供更深入的洞察和更全面的分析。

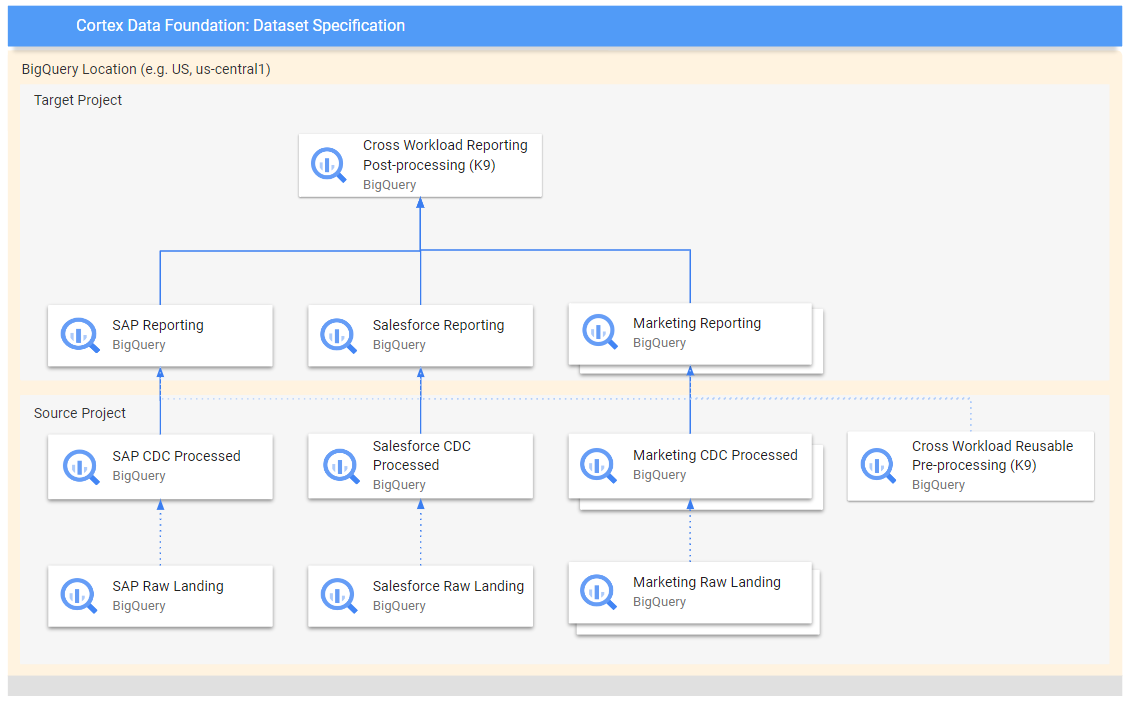

下图展示了从不同原始来源到各种报告层的数据流:

在该图中,源项目包含来自所选数据源(SAP、Salesforce 和 Marketing)的原始数据。而目标项目 包含从变更数据捕获 (CDC) 流程派生的已处理数据。

预处理 K9 步骤会在所有工作负载开始部署之前运行,因此可重复使用的模型在部署期间可用。此步骤会将来自各种来源的数据进行转换,以创建一致且可重复使用的数据集。

后处理 K9 步骤会在所有工作负载部署其报告模型后执行,以实现跨工作负载报告或扩充模型,以便在每个单独的报告数据集中查找必要的依赖项。

配置 K9 部署

在 K9 清单文件中配置要生成的有向无环图 (DAG) 和模型 。

K9 预处理步骤非常重要,因为它可确保数据流水线中的所有工作负载都可以访问一致准备的数据。这样可以减少冗余并确保数据一致性。

如需详细了解如何为 K9 配置外部数据集,请参阅为 K9 配置外部数据集。

后续步骤

完成此步骤后,请继续执行以下部署步骤: