第 1 步:建立工作负载

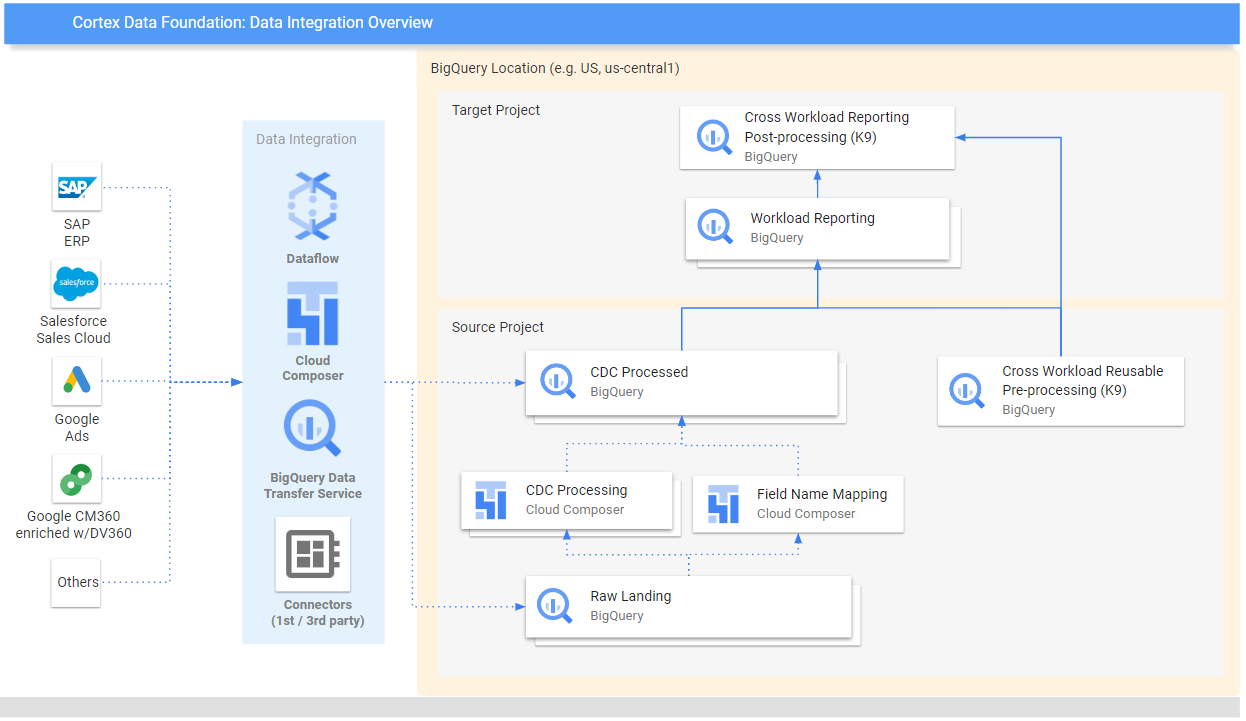

本页将引导您完成设置数据基础(Cortex Framework 的核心)的初始步骤。数据基础构建在 BigQuery 存储之上,用于整理来自各种来源的传入数据。 经过整理的数据可简化分析,并方便在 AI 开发中应用。

部署 Cortex Framework Data Foundation。设置数据集成

首先定义一些关键参数,以便在 Cortex Framework 中高效整理和使用数据。 请注意,这些参数可能会因具体工作负载、您选择的数据传输和集成机制而异。下图概述了 Cortex Framework Data Foundation 中的数据集成:

在部署之前定义以下参数,以便在 Cortex Framework 中高效利用数据。

项目

- 源项目 :原始数据所在的项目。您至少需要一个 Google Cloud 项目来存储数据并运行部署流程。

- 目标项目(可选) :Cortex Framework Data Foundation 存储其处理后的数据模型的项目。此项目可以与源项目相同,也可以不同,具体取决于您的需求。

如需详细了解如何创建项目并确保您拥有这些项目所需的 角色,请参阅前提条件 部分。

数据模型

- 部署模型 :选择是否需要为所有工作负载部署模型,或者仅部署一组模型(例如 SAP、Salesforce 和 Meta)。如需了解详情,请参阅可用的 数据源和工作负载。

BigQuery 数据集

- 源数据集(原始) :源数据复制到其中的 BigQuery 数据集,或测试数据创建在其中的 BigQuery 数据集。 建议为每个数据源使用单独的数据集。例如,一个用于 SAP 的原始数据集和一个用于 Google Ads 的原始数据集。 此数据集属于源项目。

- CDC 数据集 :CDC 处理后的数据(即最新的可用记录)所在的目标 BigQuery 数据集。某些工作负载允许进行字段名称映射。建议为每个来源使用单独的 CDC 数据集。例如,一个用于 SAP 的 CDC 数据集和一个用于 Salesforce 的 CDC 数据集。此数据集属于源项目。

- 目标报告数据集 :部署 Data Foundation 预定义数据模型的 BigQuery 数据集。 建议为每个来源使用单独的报告数据集。例如,一个用于 SAP 的报告数据集和一个用于 Salesforce 的报告数据集。如果此数据集不存在,则会在部署期间自动创建。此数据集属于目标项目。

- 预处理 K9 数据集 :可部署跨工作负载、可重复使用的 DAG 组件(例如

time维度)的 BigQuery 数据集。除非经过修改,否则工作负载会依赖于此数据集。如果此数据集不存在,则会在部署期间自动创建。此数据集属于源项目。 - 后处理 K9 数据集 :可部署跨工作负载报告和其他外部来源 DAG(例如 Google 趋势提取)的 BigQuery 数据集。如果此数据集不存在,则会在部署期间自动创建。此数据集属于目标项目。

可选:生成示例数据

如果您无权访问自己的数据,或者没有用于设置数据的复制工具,或者即使您只是想了解 Cortex Framework 的工作方式,Cortex Framework 也可以为您生成示例数据和表。不过,您仍然需要提前创建并标识 CDC 和原始数据集。

按照以下说明,为每个数据源创建原始数据和 CDC 的 BigQuery 数据集。

控制台

在 Google Cloud 控制台中打开 BigQuery 页面。

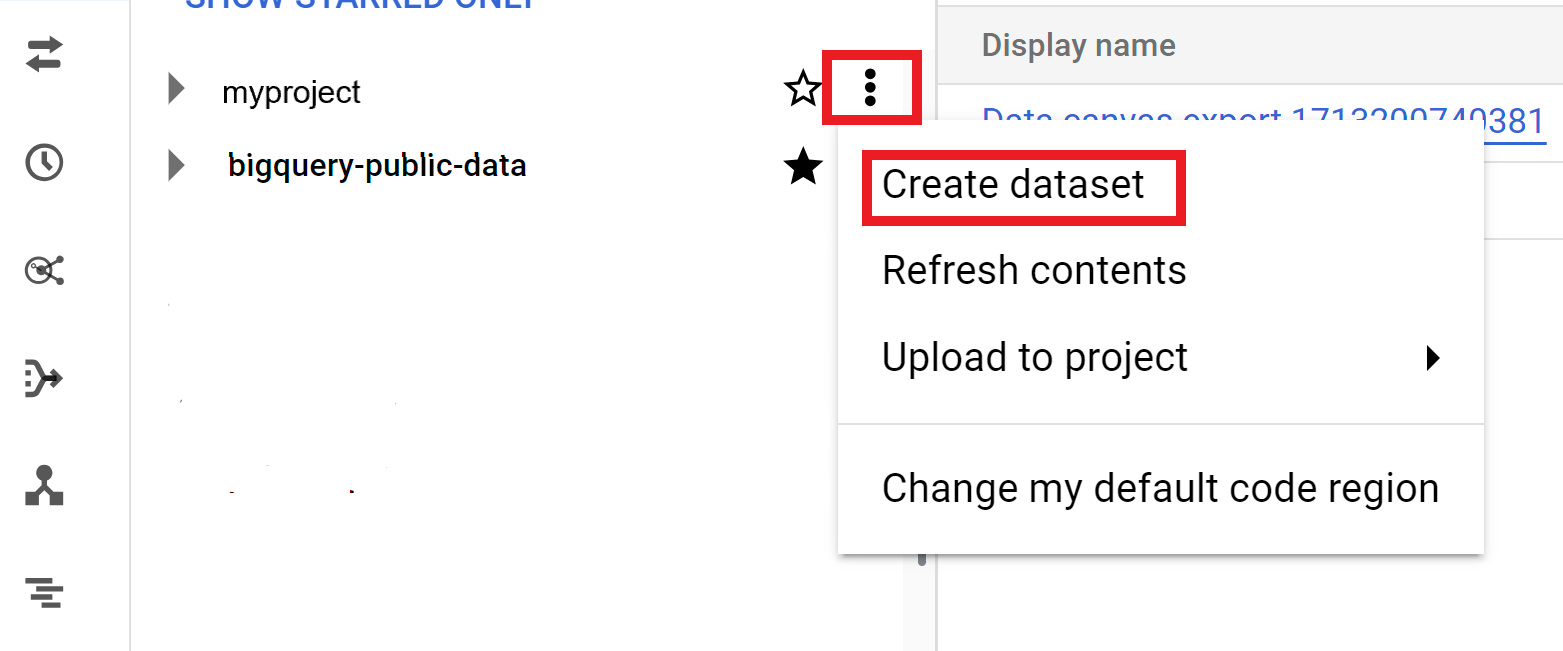

在探索器面板中,选择您要在其中创建数据集的项目。

展开 操作选项,然后点击创建数据集:

在创建数据集 页面中执行以下操作:

点击创建数据集 。

BigQuery

复制以下命令,为原始数据创建新数据集:

bq --location= LOCATION mk -d SOURCE_PROJECT: DATASET_RAW替换以下内容:

- 将

LOCATION替换为数据集的 位置。 - 将

SOURCE_PROJECT替换为您的源项目 ID。 - 将

DATASET_RAW替换为原始数据的数据集名称。例如,CORTEX_SFDC_RAW。

- 将

复制以下命令,为 CDC 数据创建新数据集:

bq --location=LOCATION mk -d SOURCE_PROJECT: DATASET_CDC替换以下内容:

- 将

LOCATION替换为数据集的 位置。 - 将

SOURCE_PROJECT替换为您的源项目 ID。 - 将

DATASET_CDC替换为 CDC 数据的数据集名称。例如,CORTEX_SFDC_CDC。

- 将

使用以下命令确认数据集已创建:

bq ls可选 。如需详细了解如何创建数据集,请参阅 创建数据集。

后续步骤

完成此步骤后,请继续执行以下部署步骤: