Google Cloud fornisce immagini che contengono sistemi operativi, framework, librerie e driver comuni. Google Cloud ottimizza queste immagini preconfigurate per supportare i tuoi workload di intelligenza artificiale (AI) e machine learning (ML).

Questo documento fornisce una panoramica delle immagini che utilizzi per eseguire il deployment, gestire ed eseguire i carichi di lavoro nel tuo ambiente AI Hypercomputer.

Informazioni sulle categorie di immagini

Le immagini sono raggruppate nelle seguenti categorie:

- Framework e librerie AI e ML: immagini Docker preconfigurate con file binari per framework e librerie ML per semplificare la creazione, l'addestramento e l'utilizzo di modelli ML. Su AI Hypercomputer, puoi utilizzare immagini Docker del livello software di deep learning (DLSL) per eseguire modelli di ML come NeMO e MaxText su un cluster Google Kubernetes Engine (GKE).

- Deployment e orchestrazione del cluster: immagini del sistema operativo (OS)

che utilizzi per eseguire il deployment e gestire

l'infrastruttura ottimizzata per il rendimento su

cui vengono eseguiti i tuoi workload AI. Puoi eseguire il deployment dei tuoi workload di AI su

cluster GKE, cluster Slurm o istanze Compute Engine.

Per ulteriori informazioni, consulta

Panoramica della creazione di VM e cluster.

Per il deployment di cluster o istanze sono disponibili le seguenti immagini del sistema operativo:

- Immagini dei nodi GKE: puoi utilizzare queste immagini per eseguire il deployment dei cluster GKE.

- Immagini del sistema operativo Slurm: Cluster Toolkit crea ed esegue il deployment di queste immagini, che installano il software di sistema necessario per i nodi Slurm.

- Immagini del sistema operativo dell'acceleratore: puoi utilizzare queste immagini per creare singole istanze o gruppi di istanze.

Framework e librerie AI e ML

Google Cloud fornisce immagini Docker che includono librerie e framework di AI e ML popolari. Queste immagini forniscono il software necessario per semplificare lo sviluppo, l'addestramento e il deployment di modelli nei cluster ottimizzati per l'AI in esecuzione su AI Hypercomputer.

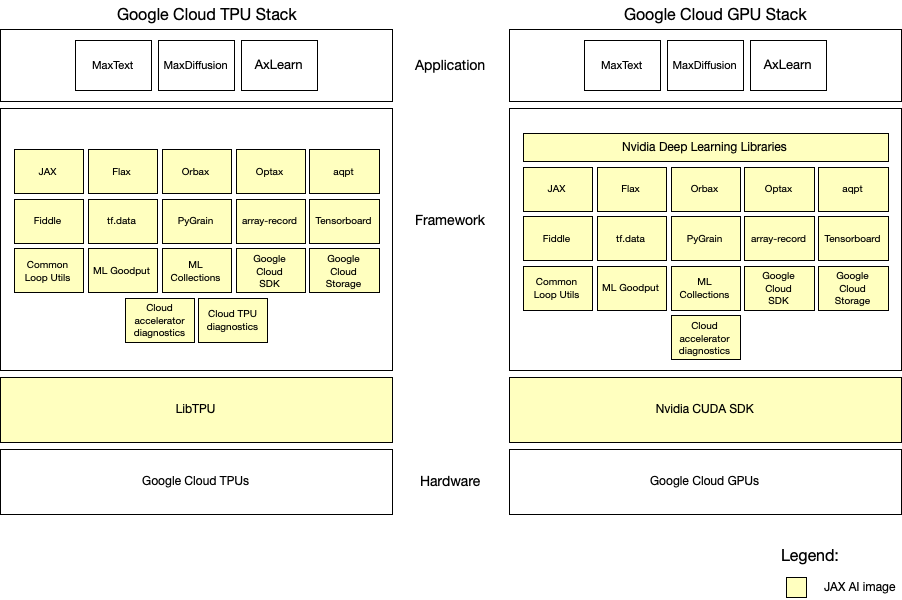

Immagini JAX AI

Le immagini AI JAX (JAII, precedentemente note come immagini JAX Stable Stack) per TPU e GPU offrono immagini Docker pronte all'uso che contengono il framework JAX, una raccolta curata di librerie compatibili e impostazioni per l'infrastruttura Google Cloud .Google Cloud Le immagini TPU AI JAX sono preconfigurate con le librerie JAX e le librerie TPU. Le immagini GPU JAX AI sono preconfigurate con le librerie JAX e le librerie CUDA/NVIDIA pertinenti.

Livello hardware

Le immagini AI JAX si trovano sopra il livello hardware, costituito dagli acceleratori (TPU o GPU) e dalle VM associate. Per utilizzare un'immagine JAX AI, devi eseguire il provisioning di VM TPU o GPU. Puoi farlo utilizzando l'API TPU, l'API Compute Engine o l'API GKE.

Il livello del framework

Il livello del framework fornisce strumenti e librerie per la creazione di carichi di lavoro ML. Le immagini AI di JAX forniscono una base preconfigurata per i carichi di lavoro di ML basati su JAX, tra cui la libreria JAX principale e altre dipendenze essenziali, per garantire un'esperienza di sviluppo coerente e ad alte prestazioni.

Il livello LibTPU nell'immagine AI JAX è creato e raggruppato in modo specifico con la rispettiva versione di JAX. L'utilizzo di una versione diversa di JAX potrebbe causare comportamenti o errori imprevisti.

Il livello CUDA nell'immagine JAX AI include componenti gestiti da NVIDIA, come l'immagine NGC CUDA Deep Learning, utilizzata come immagine di base dell'immagine di addestramento GPU. L'immagine GPU contiene anche Transformer Engine, una libreria NVIDIA personalizzata per accelerare i modelli Transformer sulle GPU NVIDIA.

Per il tuo workload di machine learning specifico potrebbero essere necessari pacchetti aggiuntivi specifici per l'applicazione, oltre a quelli forniti nell'immagine JAX AI.

Librerie in JAX AI Images:

Immagini TPU

| Funzionalità | Nome pacchetto |

|---|---|

| Librerie o componenti principali | |

| Framework ML | JAX e JAX lib |

| LibTPU | Release stabile di Cloud LibTPU |

| Libreria di livelli/modelli | Lino |

| Checkpoint | Orbax |

| Quantizzazione | Qwix |

| Ottimizzatori | Optax |

| Kernel personalizzati | Tokamax |

| Configurazione | Fiddle |

| Pipeline di input | tf.data |

| Profilazione, debug | Tensorboard |

| Utils | Common loop utils |

| Strumenti specifici per il cloud | |

| Google Cloud | |

| Diagnostica | |

Immagini GPU

| Funzionalità | Nome pacchetto |

|---|---|

| Librerie o componenti principali | |

| Framework ML | JAX e JAX lib |

| Librerie NVIDIA CUDA | Immagine CUDA DL |

| Libreria di livelli/modelli | Lino |

| Checkpoint | Orbax |

| Ottimizzatori | |

| Configurazione | Fiddle |

| Pipeline di input | |

| Profilazione, debug | Tensorboard |

| Utils | |

| Strumenti specifici per il cloud | |

| Google Cloud | |

| Diagnostica | Cloud Accelerator Diagnostics |

Immagini AI JAX attuali

Immagini TPU

| Immagine JAX AI | Data di uscita |

|---|---|

| JAX 0.9.0 Revisione 1 | 2026-02-03 |

| JAX 0.8.2 Revisione 1 | 2026-01-14 |

| JAX 0.8.1 Revisione 1 | 2025-11-21 |

| JAX 0.8.0 Revisione 1 | 2025-10-28 |

| JAX 0.7.2 Revisione 1 | 2025-09-30 |

| JAX 0.7.0 Revisione 1 | 2025-07-29 |

| JAX 0.6.1 Revisione 1 | 2025-06-05 |

| JAX 0.5.2 Revisione 2 | 2025-04-25 |

| JAX 0.5.2 Revisione 1 | 2025-03-17 |

| JAX 0.4.37 Revisione 1 | 2024-12-12 |

| JAX 0.4.35 Revisione 1 | 2024-10-30 |

Immagini GPU

| Immagine JAX AI | Data di uscita |

|---|---|

| JAX 0.7.2 con CUDA DL 25.06 Revisione 1 | 2025-09-30 |

| JAX 0.6.1 con CUDA DL 25.03 Revisione 1 | 2025-06-05 |

| JAX 0.5.1 con CUDA DL 25.02 Revisione 1 | 2025-03-17 |

Livello di applicazione

Implementi i tuoi carichi di lavoro ML specifici nel livello applicazione, che si trova sopra il livello framework. Il livello applicazione contiene il codice, i modelli e la logica specifici dell'applicazione, tutti creati utilizzando gli strumenti e le librerie forniti dal livello framework.

Sebbene questa immagine fornisca una base solida e ben testata per i carichi di lavoro di AI basati su JAX, potrebbe essere necessario aggiungere dipendenze specifiche dell'applicazione. In questo caso, ti consigliamo di farlo in modo da ridurre al minimo le interferenze con il livello di base preconfigurato, che include JAX e le relative dipendenze principali. L'introduzione di dipendenze a livello di applicazione che sostituiscono o sono in conflitto con le dipendenze esistenti può causare effetti collaterali quali:

- Comportamenti imprevisti: i carichi di lavoro di ML potrebbero presentare un comportamento diverso rispetto a prima dell'introduzione di dipendenze aggiuntive nell'immagine AI JAX.

- Regressioni delle prestazioni: l'override delle librerie ottimizzate correlate a JAX può influire negativamente sui vantaggi in termini di prestazioni forniti dall'immagine AI JAX

- Problemi di stabilità: i conflitti tra le dipendenze aggiunte e le dipendenze JAX di base possono causare instabilità ed errori di runtime all'interno dell'applicazione.

Cadenza di rilascio

Inizialmente, le immagini JAX AI vengono fornite trimestralmente con l'obiettivo a breve termine di un programma delle pubblicazioni sincronizzato con ogni release di JAX. In questo modo, potrai usufruire delle funzionalità e dei miglioramenti più recenti non appena sono disponibili.

Assistenza

Ogni release di immagini JAX AI rispetta un ciclo di vita di assistenza a tempo limitato. Entro questo periodo di tempo, esaminiamo categorie specifiche di richieste di modifiche alle immagini AI JAX esistenti:

- Vulnerabilità della sicurezza: diamo la priorità alla risoluzione delle vulnerabilità della sicurezza scoperte nelle immagini di base o nelle dipendenze delle immagini Docker JAX Stable Stack. Le immagini aggiornate verranno rilasciate per mitigare i potenziali rischi.

- Modifiche che causano interruzioni: in caso di modifiche che causano interruzioni significative nelle librerie o nei framework sottostanti utilizzati da JAX AI image, Google Cloud valuta e implementa gli aggiornamenti necessari per mantenere la compatibilità. Potrebbe essere necessario ricompilare le immagini Docker con le dipendenze aggiornate.

Quando viene scoperta una vulnerabilità della sicurezza o un bug in una libreria all'interno di un intent integrato di Android, incorporiamo la libreria aggiornata nell'intent integrato di Android, bloccando tutte le altre versioni della libreria per mantenere la stabilità complessiva. Di conseguenza, viene generata una nuova revisione JAII.

Modifica minima per le revisioni:

Se viene trovato un bug nel pacchetto "X" all'interno di JAX-0.4.30-rev1, aggiorneremo "X" alla versione successiva (ad esempio, v2.0) cercando di mantenere invariati tutti gli altri pacchetti. Il risultato è una nuova revisione: JAX-0.4.30-rev2, che verrà rilasciata il prima possibile.

Immagini Docker del livello software di deep learning (DLSL)

Queste immagini includono NVIDIA CUDA, NCCL, un framework di ML e un modello. Forniscono un ambiente pronto all'uso per i workload di deep learning. Queste immagini Docker DLSL predefinite funzionano perfettamente con i tuoi cluster GKE perché le testiamo e verifichiamo durante i test di regressione e riproducibilità interni.

Le immagini Docker DLSL offrono i seguenti vantaggi:

- Software preconfigurato: le immagini Docker DLSL replicano la configurazione utilizzata per i test di riproducibilità e regressione interni. Queste immagini forniscono un ambiente preconfigurato, testato e ottimizzato, il che consente di risparmiare tempo e impegno significativi in termini di installazione e configurazione.

- Gestione delle versioni: le immagini Docker DLSL vengono aggiornate di frequente. Questi aggiornamenti della versione forniscono l'ultima versione stabile di framework e driver e includono anche patch di sicurezza.

- Compatibilità dell'infrastruttura: le immagini Docker DLSL sono create e testate per funzionare perfettamente con i tipi di macchine GPU disponibili su AI Hypercomputer.

- Istruzioni per la guida rapida: alcune immagini Docker DLSL sono accompagnate da ricette di esempio che mostrano come avviare i workload che utilizzano le immagini preconfigurate.

Plug-in NeMo + PyTorch + NCCL gIB

Queste immagini Docker si basano sull'immagine NVIDIA NeMo NGC. Contengono il plug-in gIB NCCL di Google e raggruppano tutti i file binari NCCL necessari per eseguire i carichi di lavoro su ogni macchina acceleratore supportata. Queste immagini includono anche strumenti Google Cloud

come gcsfuse e la

gcloud CLI per il deployment dei carichi di lavoro in

Google Kubernetes Engine.

| Versione immagine DLSL | Versione delle dipendenze | Serie di macchine | Data di uscita | Data di fine del supporto | Nome immagine DLSL |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3 luglio 2025 | 3 luglio 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3 luglio 2025 | 3 luglio 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14 marzo 2025 | 14 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2 febbraio 2025 | 2 febbraio 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2 febbraio 2025 | 2 febbraio 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7 febbraio 2025 | 7 febbraio 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 marzo 2025 | 12 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPU) | 12 marzo 2025 | 12 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

Questa immagine Docker si basa sull'immagine NVIDIA NeMo NGC e include Google Cloud strumenti come gcsfuse e

interfaccia a riga di comando gcloud per il deployment dei carichi di lavoro su Google Kubernetes Engine.

| Versione immagine DLSL | Versione delle dipendenze | Serie di macchine | Data di uscita | Data di fine del supporto | Nome immagine DLSL |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | 19 dicembre 2024 | 19 dicembre 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 marzo 2025 | 12 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPU) | 12 marzo 2025 | 12 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + JAX toolbox

Questa immagine Docker si basa sull'immagine

NVIDIA JAX toolbox e include

strumentiGoogle Cloud come

gcsfuse e

gcloud CLI per il deployment dei carichi di lavoro in

Google Kubernetes Engine.

| Versione immagine DLSL | Versione delle dipendenze | Serie di macchine | Data di uscita | Data di fine del supporto | Nome immagine DLSL |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11 marzo 2025 | 11 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17 marzo 2025 | 17 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 GPU) | 17 marzo 2025 | 17 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + JAX stable stack

Questa immagine Docker si basa sullo

stack stabile JAX

e su MaxText. Questa immagine include anche

dipendenze come dnsutils per l'esecuzione di carichi di lavoro su

Google Kubernetes Engine.

| Versione immagine DLSL | Versione delle dipendenze | Serie di macchine | Data di uscita | Data di fine del supporto | Nome immagine DLSL |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17 marzo 2025 | 17 marzo 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Deployment e orchestrazione del cluster

Le immagini del sistema operativo includono tutti i componenti software necessari per eseguire il deployment di un sistema operativo su un'istanza di computing o un nodo GKE. Il sistema operativo gestisce le risorse hardware sottostanti, come gli acceleratori e la rete. Fornisce le risorse di calcolo per il tuo workload AI.

Immagini dei nodi GKE

GKE esegue il deployment dei cluster utilizzando le immagini dei nodi. Queste immagini dei nodi sono disponibili per vari sistemi operativi, come Container-Optimized OS, Ubuntu e Windows Server. Le immagini dei nodi Container-Optimized OS con containerd (cos_containerd) che devi utilizzare per il deployment dei cluster GKE Autopilot includono ottimizzazioni per supportare i tuoi workload di AI e ML.

Per saperne di più su queste immagini dei nodi, consulta la sezione Immagini dei nodi.

Immagini sistema operativo Slurm

I cluster Slurm eseguono il deployment dei nodi di calcolo e controller come istanze di calcolo su Compute Engine.

Per eseguire il provisioning dei cluster Slurm ottimizzati per l'AI, devi utilizzare Cluster Toolkit. Durante il deployment del cluster Slurm, il blueprint del cluster crea automaticamente un'immagine del sistema operativo personalizzata che installa il software di sistema richiesto per la gestione del cluster e del workload sui nodi Slurm. Puoi modificare i blueprint predefiniti prima di eseguirne il deployment per personalizzare alcuni dei software inclusi nelle immagini.

La sezione seguente riepiloga il software che il blueprint del cluster installa sui nodi Slurm A4, A3 Ultra, A3 Mega e A3 High (8 GPU). I progetti cluster estendono le immagini del sistema operativo Ubuntu LTS Accelerator.

A4X Max

Il progetto A4X Max disponibile su GitHub include il seguente software per impostazione predefinita:

- Ubuntu 24.04 LTS

- Slurm: versione 25.05.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: versione 5.0.x

- Client e server NFS

- Driver NVIDIA serie 580

- NVIDIA Enroot

- NVIDIA Pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: versione 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- Toolkit CUDA: versione 13.0

- Plug-in NCCL per A4X Max (

nccl-gib-a4x-max-arm64) - Driver DOCA-OFED

- Ops Agent

- Cloud Storage FUSE

A4X

Il blueprint A4X disponibile su GitHub include il seguente software per impostazione predefinita:

- Ubuntu 24.04 LTS

- Slurm: versione 25.05.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: versione 5.0.x

- Client e server NFS

- Driver NVIDIA serie 570

- NVIDIA Enroot

- NVIDIA Pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) nvidia-container-toolkit: versione 1.17.7nvidia-imexnvidia-fabricmanager

- Data Center GPU Manager (

- Toolkit CUDA: versione 12.8

- Plug-in NCCL per A4X (

nccl-plugin-gib-arm64) - Ops Agent

- Cloud Storage FUSE

A4

Il progetto base A4 disponibile su GitHub include per impostazione predefinita il seguente software:

- Ubuntu 22.04 LTS

- Slurm: versione 25.05.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: l'ultima release di 4.1.x

- PMIx: versione 4.2.9

- Client e server NFS

- Driver NVIDIA serie 570

- Runtime del contenitore NVIDIA enroot: versione 3.5.0 con correzione di bug post-release

- NVIDIA pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Data Center GPU Manager (

- Toolkit CUDA: versione 12.8

- Supporto di Infiniband, incluso

ibverbs-utils - Ops Agent

- Cloud Storage FUSE

A3 Ultra

Il blueprint A3 Ultra disponibile su GitHub include per impostazione predefinita il seguente software:

- Ubuntu 22.04 LTS

- Slurm: versione 24.11.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: l'ultima release di 4.1.x

- PMIx: versione 4.2.9

- Client e server NFS

- Driver NVIDIA serie 570

- Runtime del contenitore NVIDIA enroot: versione 3.5.0 con correzione di bug post-release

- NVIDIA pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Data Center GPU Manager (

- Toolkit CUDA: versione 12.8

- Supporto di Infiniband, incluso

ibverbs-utils - Ops Agent

- Cloud Storage FUSE

A3 Mega

Il blueprint A3 Mega disponibile su GitHub include il seguente software per impostazione predefinita:

- Ubuntu 22.04 LTS

- Slurm: versione 24.11.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: l'ultima release di 4.1.x

- PMIx: versione 4.2.9

- Client e server NFS

- Driver NVIDIA serie 550

- Runtime del container NVIDIA enroot: versione 3.4.1

- NVIDIA pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Data Center GPU Manager (

- Toolkit CUDA: versione 12.4

- Supporto di Infiniband, incluso

ibverbs-utils - TCPXO per A3 Mega: programma di installazione specifico per NCCL TCPXO e lo stack di rete da 1,6 Tbps

- Ops Agent

- Cloud Storage FUSE

A3 High

Il progetto base A3 High (8 GPU) disponibile su GitHub include il seguente software per impostazione predefinita:

- Ubuntu 22.04 LTS

- Slurm: versione 24.11.2

- Le seguenti dipendenze di Slurm:

mungemariadblibjwtlmod

- Open MPI: l'ultima release di 4.1.x

- PMIx: versione 4.2.9

- Client e server NFS

- Driver NVIDIA serie 535 o 550

- Runtime del container NVIDIA enroot: versione 3.4.1

- NVIDIA pyxis

- I seguenti strumenti NVIDIA:

- Data Center GPU Manager (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Data Center GPU Manager (

- Toolkit CUDA: versione 12.2 o 12.4

- Supporto di Infiniband, incluso

ibverbs-utils - TCPX per A3 High (8 GPU): programma di installazione specifico per NCCL TCPX (GPUDirect-TCPX) e lo stack di rete da 800 Gbps (4 NIC)

- Ops Agent

- Cloud Storage FUSE

Immagini sistema operativo dell'acceleratore

AI Hypercomputer ti consente di eseguire il provisioning di singole istanze di computing o gruppi di istanze di computing. Se vuoi creare queste istanze, devi specificare un'immagine del sistema operativo durante la creazione dell'istanza.

Google Cloud offre una suite di immagini del sistema operativo per la creazione di istanze. Google Cloud offre anche un insieme specializzato di immagini del sistema operativo dell'acceleratore per istanze ottimizzate per l'AI. Queste immagini del sistema operativo includono i driver di base per la funzionalità di GPU e networking, come i driver NVIDIA, i driver Mellanox e le relative dipendenze.

Per saperne di più su ciascun sistema operativo, consulta la pagina Dettagli del sistema operativo nella documentazione di Compute Engine.

Le immagini del sistema operativo Accelerator sono disponibili per i sistemi operativi Rocky Linux e Ubuntu LTS.

Acceleratore Rocky Linux

Per ogni serie di macchine sono disponibili le seguenti immagini del sistema operativo Rocky Linux ottimizzato per l'acceleratore:

| Versione sistema operativo | Famiglia di immagini | Architettura | Serie di macchine | Progetto di immagini |

|---|---|---|---|---|

| Acceleratore Rocky Linux 9 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

| Acceleratore Rocky Linux 8 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | rocky-linux-accelerator-cloud |

Acceleratore Ubuntu LTS

Per ogni serie di macchine sono disponibili le seguenti immagini del sistema operativo Ubuntu LTS Accelerator:

| Versione sistema operativo | Famiglia di immagini | Architettura | Serie di macchine | Progetto di immagini |

|---|---|---|---|---|

| Acceleratore Ubuntu 24.04 LTS | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

| Acceleratore Ubuntu 22.04 LTS | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPU) | ubuntu-os-accelerator-images |