Google Cloud proporciona imágenes que contienen sistemas operativos, frameworks, bibliotecas y controladores comunes. Google Cloud optimiza estas imágenes preconfiguradas para admitir tus cargas de trabajo de Inteligencia Artificial (IA) y aprendizaje automático (AA).

En este documento, se proporciona una descripción general de las imágenes que usas para implementar, administrar y ejecutar cargas de trabajo en tu entorno de AI Hypercomputer.

Comprende las categorías de imágenes

Las imágenes se agrupan en las siguientes categorías:

- Frameworks y bibliotecas de IA y AA: Imágenes de Docker preconfiguradas con objetos binarios para frameworks y bibliotecas de AA que simplifican la creación, el entrenamiento y el uso de modelos de AA. En la AI Hypercomputer, puedes usar imágenes de Docker de Deep Learning Software Layer (DLSL) para ejecutar modelos de AA, como NeMO y MaxText, en un clúster de Google Kubernetes Engine (GKE).

- Implementación y organización de clústeres: Imágenes del sistema operativo (SO) que usas para implementar y administrar la infraestructura optimizada para el rendimiento en la que se ejecutan tus cargas de trabajo de IA. Puedes implementar tus cargas de trabajo de IA en clústeres de GKE, clústeres de Slurm o instancias de Compute Engine.

Para obtener más información, consulta Descripción general de la creación de VMs y clústeres.

Las siguientes imágenes del sistema operativo están disponibles para la implementación de clústeres o instancias:

- Imágenes de nodos de GKE: Puedes usar estas imágenes para implementar clústeres de GKE.

- Imágenes del SO de Slurm: Cluster Toolkit compila y, luego, implementa estas imágenes, que instalan el software del sistema necesario para los nodos de Slurm.

- Imágenes del SO del acelerador: Puedes usar estas imágenes para crear instancias de VM individuales o en grupos.

Frameworks y bibliotecas de IA y AA

Google Cloud proporciona imágenes de Docker que empaquetan frameworks y bibliotecas populares de IA y AA. Estas imágenes proporcionan el software necesario para simplificar el desarrollo, el entrenamiento y la implementación de modelos en tus clústeres optimizados para IA que se ejecutan en AI Hypercomputer.

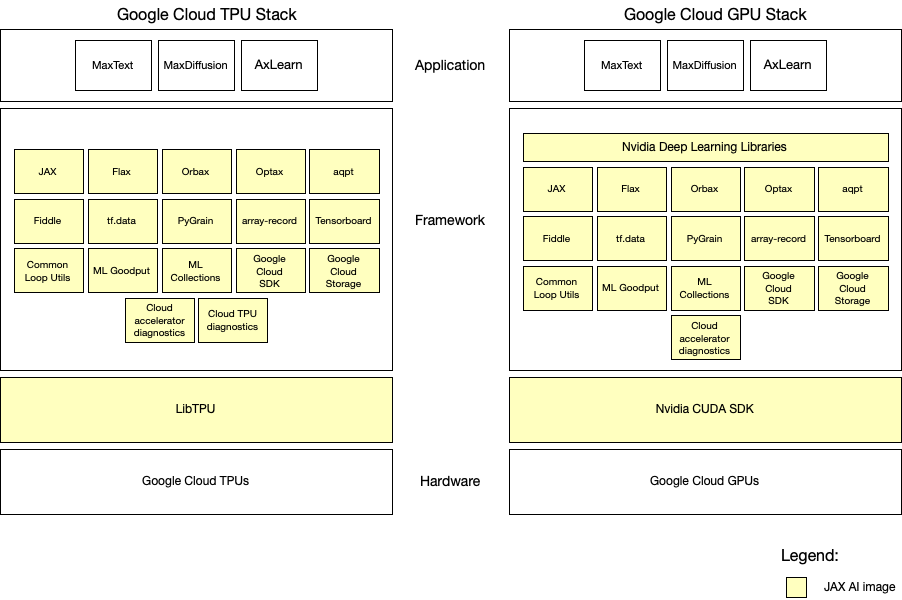

Imágenes generadas por IA de JAX

Las imágenes de IA de JAX (JAII, anteriormente conocidas como imágenes de pila estable de JAX) para TPU y GPU ofrecen imágenes de Docker listas para usar que contienen el framework de JAX, una colección seleccionada de bibliotecas compatibles y la configuración para la infraestructura de Google Cloud .Google Cloud Las imágenes de TPU para IA de JAX vienen preconfiguradas con bibliotecas de JAX y bibliotecas de TPU. Las imágenes de GPU de IA de JAX vienen preconfiguradas con bibliotecas de JAX y bibliotecas de CUDA/NVIDIA pertinentes.

La capa de hardware

Las imágenes de IA de JAX se encuentran en la parte superior de la capa de hardware, que consta de los aceleradores (TPU o GPU) y sus VMs asociadas. Para usar una imagen de IA de JAX, debes aprovisionar VMs de TPU o GPU. Puedes hacerlo con la API de TPU, la API de Compute Engine o la API de GKE.

La capa del framework

La capa de framework proporciona herramientas y bibliotecas para compilar cargas de trabajo de AA. Las imágenes de IA de JAX proporcionan una base preconfigurada para las cargas de trabajo de AA basadas en JAX, incluida la biblioteca principal de JAX y otras dependencias esenciales, para garantizar una experiencia de desarrollo coherente y de alto rendimiento.

La capa LibTPU en la imagen generada por IA de JAX se compila y se incluye específicamente con la versión de JAX correspondiente. Si usas una versión diferente de JAX, es posible que se produzcan errores o comportamientos inesperados.

La capa de CUDA en la imagen de IA de JAX incluye componentes administrados por NVIDIA, como la imagen de aprendizaje profundo de CUDA de NGC, que se usa como imagen base de la imagen de entrenamiento de GPU. La imagen de GPU también contiene Transformer Engine, una biblioteca personalizada de NVIDIA para acelerar los modelos de Transformer en las GPUs de NVIDIA.

Es posible que se requieran paquetes adicionales específicos de la aplicación, más allá de los que se proporcionan en la imagen de IA de JAX, para tu carga de trabajo de aprendizaje automático específica.

Bibliotecas en JAX AI Images:

Imágenes de TPU

| Funcionalidad | Nombre del paquete |

|---|---|

| Bibliotecas o componentes principales | |

| Framework de AA | JAX y JAX lib |

| LibTPU | Versión estable de Cloud LibTPU |

| Biblioteca de capas y modelos | Flax |

| Creación de puntos de control | Orbax |

| Cuantización | Qwix |

| Optimizadores | Optax |

| Kernels personalizados | Tokamax |

| Configuración | Fiddle |

| Canalización de entrada | tf.data |

| Generación de perfiles y depuración | TensorBoard |

| Utils | Utilidades de bucle comunes |

| Herramientas específicas de la nube | |

| Google Cloud | |

| Diagnóstico |

Diagnóstico del acelerador de Cloud Diagnóstico de Cloud TPU |

Imágenes de GPU

| Funcionalidad | Nombre del paquete |

|---|---|

| Bibliotecas o componentes principales | |

| Framework de AA | JAX y JAX lib |

| Bibliotecas de NVIDIA CUDA | Imagen de DL de CUDA |

| Biblioteca de capas y modelos | Flax |

| Creación de puntos de control | Orbax |

| Optimizadores | |

| Configuración | Fiddle |

| Canalización de entrada | |

| Generación de perfiles y depuración | TensorBoard |

| Utils |

Utilidades comunes de bucle Medición del procesamiento útil de AA Colecciones de AA |

| Herramientas específicas de la nube | |

| Google Cloud | |

| Diagnóstico | Diagnóstico de Cloud Accelerator |

Imágenes generadas por IA de JAX actuales

Imágenes de TPU

| Imagen generada por IA de JAX | Fecha de lanzamiento |

|---|---|

| JAX 0.9.0, revisión 1 | 2026-02-03 |

| Revisión 1 de JAX 0.8.2 | 2026-01-14 |

| Revisión 1 de JAX 0.8.1 | 2025-11-21 |

| Revisión 1 de JAX 0.8.0 | 2025-10-28 |

| JAX 0.7.2, revisión 1 | 2025-09-30 |

| JAX 0.7.0, revisión 1 | 2025-07-29 |

| JAX 0.6.1, revisión 1 | 2025-06-05 |

| JAX 0.5.2, revisión 2 | 2025-04-25 |

| JAX 0.5.2, revisión 1 | 2025-03-17 |

| JAX 0.4.37, revisión 1 | 2024-12-12 |

| JAX 0.4.35, revisión 1 | 2024-10-30 |

Imágenes de GPU

| Imagen generada por IA de JAX | Fecha de lanzamiento |

|---|---|

| JAX 0.7.2 con CUDA DL 25.06, revisión 1 | 2025-09-30 |

| JAX 0.6.1 con CUDA DL 25.03, revisión 1 | 2025-06-05 |

| JAX 0.5.1 con CUDA DL 25.02, revisión 1 | 2025-03-17 |

La capa de aplicación

Implementas tus cargas de trabajo de AA específicas en la capa de la aplicación, que se encuentra sobre la capa del framework. La capa de aplicación contiene el código, los modelos y la lógica específicos de tu aplicación, todos compilados con las herramientas y las bibliotecas que proporciona la capa de framework.

Si bien esta imagen proporciona una base sólida y bien probada para las cargas de trabajo de IA basadas en JAX, es posible que debas agregar dependencias específicas de la aplicación. Cuando lo hagas, te recomendamos que lo hagas de una manera que minimice la interferencia con la capa base preconfigurada, que incluye JAX y sus dependencias principales. La introducción de dependencias a nivel de la aplicación que anulan o entran en conflicto con las dependencias existentes puede causar efectos secundarios, como los siguientes:

- Comportamientos inesperados: Es posible que tus cargas de trabajo de AA muestren un comportamiento diferente al que tenían antes de que introdujeras dependencias adicionales en la imagen de AA de JAX.

- Regresiones de rendimiento: Anular las bibliotecas optimizadas relacionadas con JAX puede afectar negativamente los beneficios de rendimiento que proporciona la imagen generada por IA de JAX.

- Problemas de estabilidad: Los conflictos entre las dependencias que agregaste y las dependencias principales de JAX pueden generar inestabilidad y errores de tiempo de ejecución en tu aplicación.

Frecuencia de actualización

Inicialmente, las imágenes de IA de JAX se proporcionan trimestralmente, con el objetivo a corto plazo de tener un programa de lanzamiento sincronizado con cada lanzamiento de JAX. Esto garantiza que puedas beneficiarte de las funciones y mejoras más recientes en cuanto estén disponibles.

Asistencia

Cada lanzamiento de imágenes creadas con IA de JAX cumple con un ciclo de vida de asistencia técnica por tiempo limitado. En este plazo, abordamos categorías específicas de solicitudes de modificaciones a imágenes existentes generadas por IA de JAX:

- Vulnerabilidades de seguridad: Priorizamos abordar las vulnerabilidades de seguridad descubiertas en las imágenes base o las dependencias de las imágenes de Docker de JAX Stable Stack. Se lanzarán imágenes actualizadas para mitigar los riesgos potenciales.

- Cambios rotundos: En caso de que haya cambios rotundos significativos en las bibliotecas o los frameworks subyacentes que usa la imagen de IA de JAX, Google Cloudevalúa e implementa las actualizaciones necesarias para mantener la compatibilidad. Esto puede implicar volver a compilar imágenes de Docker con dependencias actualizadas.

Cuando se descubre una vulnerabilidad o un error de seguridad en una biblioteca dentro de la JAII, incorporamos la biblioteca actualizada en la JAII y fijamos todas las demás versiones de la biblioteca para mantener la estabilidad general. Esto da como resultado una nueva revisión de la JAII.

Cambio mínimo para las revisiones:

Si se encuentra un error en el paquete "X" dentro de JAX-0.4.30-rev1, actualizaremos "X" a su próxima versión (por ejemplo, v2.0) y trataremos de mantener todos los demás paquetes sin cambios. Esto generará una nueva revisión: JAX-0.4.30-rev2, que se lanzará lo antes posible.

Imágenes de Docker de la capa de software de aprendizaje profundo (DLSL)

Estas imágenes empaquetan NVIDIA CUDA, NCCL, un framework de AA y un modelo. Proporcionan un entorno listo para usar para las cargas de trabajo de aprendizaje profundo. Estas imágenes de Docker de DLSL prediseñadas funcionan a la perfección con tus clústeres de GKE porque las probamos y verificamos durante las pruebas internas de reproducibilidad y regresión.

Las imágenes de Docker de DLSL proporcionan los siguientes beneficios:

- Software preconfigurado: Las imágenes de Docker de DLSL replican la configuración que se usa para las pruebas internas de reproducibilidad y regresión. Estas imágenes proporcionan un entorno preconfigurado, probado y optimizado, lo que ahorra una gran cantidad de tiempo y esfuerzo en la instalación y la configuración.

- Administración de versiones: Las imágenes de Docker de DLSL se actualizan con frecuencia. Estas actualizaciones de versión proporcionan la versión estable más reciente de los frameworks y los controladores, y también abordan los parches de seguridad.

- Compatibilidad con la infraestructura: Las imágenes de Docker de DLSL se compilan y prueban para que funcionen sin problemas con los tipos de máquinas con GPU disponibles en AI Hypercomputer.

- Instrucciones de inicio rápido: Algunas imágenes de Docker de DLSL incluyen recetas de muestra que te muestran cómo iniciar tus cargas de trabajo que usan las imágenes preconfiguradas.

Complemento de NeMo + PyTorch + NCCL gIB

Estas imágenes de Docker se basan en la imagen de NVIDIA NeMo NGC. Contienen el complemento gIB de NCCL de Google y agrupan todos los archivos binarios de NCCL necesarios para ejecutar cargas de trabajo en cada máquina aceleradora compatible. Estas imágenes también incluyen herramientas de Google Cloudcomo gcsfusey la

CLI de gcloudpara implementar cargas de trabajo en Google Kubernetes Engine.

| Versión de imagen de DLSL | Versión de las dependencias | Series de máquinas | Fecha de lanzamiento | Fecha de finalización de la asistencia | Nombre de la imagen de DLSL |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3 de julio de 2025 | 3 de julio de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3 de julio de 2025 | 3 de julio de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14 de marzo de 2025 | 14 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2 de febrero de 2025 | 2 de febrero de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2 de febrero de 2025 | 2 de febrero de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7 de febrero de 2025 | 7 de febrero de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 de marzo de 2025 | 12 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12 de marzo de 2025 | 12 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo y PyTorch

Esta imagen de Docker se basa en la imagen de NVIDIA NeMo NGC y contiene Google Cloud herramientas como gcsfuse y

gcloud CLI para implementar cargas de trabajo en Google Kubernetes Engine.

| Versión de imagen de DLSL | Versión de las dependencias | Series de máquinas | Fecha de lanzamiento | Fecha de finalización de la asistencia | Nombre de la imagen de DLSL |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | December 19, 2024 | 19 de diciembre de 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 de marzo de 2025 | 12 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12 de marzo de 2025 | 12 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

Caja de herramientas de MaxText y JAX

Esta imagen de Docker se basa en la imagen de la caja de herramientas de JAX de NVIDIA y contieneGoogle Cloud herramientas como gcsfuse y

gcloud CLI para implementar cargas de trabajo en Google Kubernetes Engine.

| Versión de imagen de DLSL | Versión de las dependencias | Series de máquinas | Fecha de lanzamiento | Fecha de finalización de la asistencia | Nombre de la imagen de DLSL |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11 de marzo de 2025 | 11 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17 de marzo de 2025 | 17 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 GPUs) | 17 de marzo de 2025 | 17 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

Pila estable de MaxText y JAX

Esta imagen de Docker se basa en la pila estable de JAX y MaxText. Esta imagen también incluye dependencias, como dnsutils, para ejecutar cargas de trabajo en Google Kubernetes Engine.

| Versión de imagen de DLSL | Versión de las dependencias | Series de máquinas | Fecha de lanzamiento | Fecha de finalización de la asistencia | Nombre de la imagen de DLSL |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17 de marzo de 2025 | 17 de marzo de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Implementación y organización de clústeres

Las imágenes de SO incluyen todos los componentes de software necesarios para implementar un sistema operativo en una instancia de procesamiento o un nodo de GKE. El sistema operativo administra los recursos de hardware subyacentes, como los aceleradores y las redes. Esto proporciona los recursos de procesamiento para tu carga de trabajo de IA.

Imágenes de nodos de GKE

GKE implementa clústeres con imágenes de nodos. Estas imágenes de nodo están disponibles para varios sistemas operativos, como Container-Optimized OS, Ubuntu y Windows Server. Las imágenes de nodo de Container-Optimized OS con containerd (cos_containerd) que necesitas para implementar clústeres de GKE Autopilot incluyen optimizaciones para admitir tus cargas de trabajo de IA y AA.

Para obtener más información sobre estas imágenes de nodo, consulta Imágenes de nodo.

Imágenes de SO de Slurm

Los clústeres de Slurm implementan nodos de procesamiento y de controlador como instancias de procesamiento en Compute Engine.

Para aprovisionar clústeres de Slurm optimizados para IA, debes usar Cluster Toolkit. Durante la implementación del clúster de Slurm, el blueprint del clúster compila automáticamente una imagen de SO personalizada que instala el software del sistema requerido para la administración del clúster y la carga de trabajo en los nodos de Slurm. Puedes modificar los planos predeterminados antes de implementarlos para personalizar parte del software que incluyen tus imágenes.

En la siguiente sección, se resume el software que el modelo de clúster instala en tus nodos de Slurm A4, A3 Ultra, A3 Mega y A3 High (8 GPUs). Los planos del clúster extienden las imágenes del SO de Ubuntu LTS Accelerator.

A4

El plano técnico de A4 disponible en GitHub incluye el siguiente software de forma predeterminada:

- LTS de Ubuntu 22.04

- Slurm: versión 24.11.2

- Las siguientes dependencias de Slurm:

mungemariadblibjwtlmod

- Open MPI: La versión más reciente de 4.1.x

- PMIx: versión 4.2.9

- Cliente y servidor de NFS

- Controladores de la serie NVIDIA 570

- Tiempo de ejecución del contenedor NVIDIA enroot: versión 3.5.0 con corrección de errores posterior al lanzamiento

- NVIDIA pyxis

- Las siguientes herramientas de NVIDIA:

- Administrador de GPU del centro de datos (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Administrador de GPU del centro de datos (

- Kit de herramientas de CUDA: versión 12.8

- Compatibilidad con Infiniband, incluido

ibverbs-utils - Agente de operaciones

- Cloud Storage FUSE

A3 Ultra

El plano de A3 Ultra disponible en GitHub incluye el siguiente software de forma predeterminada:

- LTS de Ubuntu 22.04

- Slurm: versión 24.11.2

- Las siguientes dependencias de Slurm:

mungemariadblibjwtlmod

- Open MPI: La versión más reciente de 4.1.x

- PMIx: versión 4.2.9

- Cliente y servidor de NFS

- Controladores de la serie NVIDIA 570

- Tiempo de ejecución del contenedor NVIDIA enroot: versión 3.5.0 con corrección de errores posterior al lanzamiento

- NVIDIA pyxis

- Las siguientes herramientas de NVIDIA:

- Administrador de GPU del centro de datos (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Administrador de GPU del centro de datos (

- Kit de herramientas de CUDA: versión 12.8

- Compatibilidad con Infiniband, incluido

ibverbs-utils - Agente de operaciones

- Cloud Storage FUSE

A3 Mega

El plano A3 Mega disponible en GitHub incluye el siguiente software de forma predeterminada:

- LTS de Ubuntu 22.04

- Slurm: versión 24.11.2

- Las siguientes dependencias de Slurm:

mungemariadblibjwtlmod

- Open MPI: La versión más reciente de 4.1.x

- PMIx: versión 4.2.9

- Cliente y servidor de NFS

- Controladores de la serie 550 de NVIDIA

- Tiempo de ejecución del contenedor NVIDIA enroot: versión 3.4.1

- NVIDIA pyxis

- Las siguientes herramientas de NVIDIA:

- Administrador de GPU del centro de datos (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Administrador de GPU del centro de datos (

- Kit de herramientas de CUDA: versión 12.4

- Compatibilidad con Infiniband, incluido

ibverbs-utils - TCPXO para A3 Mega: Instalador específico para NCCL TCPXO y la pila de red de 1.6 Tbps

- Agente de operaciones

- Cloud Storage FUSE

A3 High

El blueprint de A3 High (8 GPUs) disponible en GitHub incluye el siguiente software de forma predeterminada:

- LTS de Ubuntu 22.04

- Slurm: versión 24.11.2

- Las siguientes dependencias de Slurm:

mungemariadblibjwtlmod

- Open MPI: La versión más reciente de 4.1.x

- PMIx: versión 4.2.9

- Cliente y servidor de NFS

- Controladores de las series 535 o 550 de NVIDIA

- Tiempo de ejecución del contenedor NVIDIA enroot: versión 3.4.1

- NVIDIA pyxis

- Las siguientes herramientas de NVIDIA:

- Administrador de GPU del centro de datos (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Administrador de GPU del centro de datos (

- Kit de herramientas de CUDA: versión 12.2 o 12.4

- Compatibilidad con Infiniband, incluido

ibverbs-utils - TCPX para A3 High (8 GPUs): Instalador específico para NCCL TCPX (GPUDirect-TCPX) y la pila de red de 800 Gbps (4 NIC)

- Agente de operaciones

- Cloud Storage FUSE

Imágenes de SO de acelerador

AI Hypercomputer te permite aprovisionar instancias de procesamiento individuales o grupos de instancias de procesamiento. Si deseas crear estas instancias, debes especificar una imagen de SO durante la creación de la instancia.

Google Cloud ofrece un paquete de imágenes de SO para la creación de instancias. Google Cloud también ofrece un conjunto especializado de imágenes de SO del acelerador para instancias optimizadas para IA. Estas imágenes de SO incluyen controladores principales para la funcionalidad de GPU y redes, como los controladores de NVIDIA y Mellanox, y sus dependencias.

Para obtener más información sobre cada SO, consulta la página Detalles del sistema operativo en la documentación de Compute Engine.

Las imágenes del SO del acelerador están disponibles para los sistemas operativos Rocky Linux y Ubuntu LTS.

Acelerador de Rocky Linux

Las siguientes imágenes del SO acelerador de Rocky Linux están disponibles para cada serie de máquinas:

| Versión del SO | Familia de imágenes | Arquitectura | Series de máquinas | Proyecto de imagen |

|---|---|---|---|---|

| Acelerador de Rocky Linux 9 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max y A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

| Acelerador de Rocky Linux 8 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max y A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

Acelerador de LTS de Ubuntu

Las siguientes imágenes del SO de acelerador de Ubuntu LTS están disponibles para cada serie de máquinas:

| Versión del SO | Familia de imágenes | Arquitectura | Series de máquinas | Proyecto de imagen |

|---|---|---|---|---|

| Acelerador de Ubuntu 24.04 LTS | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max y A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

| Acelerador de LTS de Ubuntu 22.04 | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max y A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega y A3 High (8 GPUs) | ubuntu-os-accelerator-images |