OGoogle Cloud fornece imagens que contêm sistemas operacionais, frameworks, bibliotecas e drivers comuns.O Google Cloud otimiza essas imagens pré-configuradas para oferecer suporte às suas cargas de trabalho de inteligência artificial (IA) e machine learning (ML).

Este documento oferece uma visão geral das imagens usadas para implantar, gerenciar e executar cargas de trabalho no ambiente do Hipercomputador de IA.

Entenda as categorias de imagens

As imagens são agrupadas nas seguintes categorias:

- Frameworks e bibliotecas de IA e ML: imagens do Docker pré-configuradas com binários para frameworks e bibliotecas de ML, simplificando a criação, o treinamento e o uso de modelos de ML. No Hipercomputador de IA, é possível usar imagens Docker da camada de software de aprendizado profundo (DLSL) para executar modelos de ML como NeMO e MaxText em um cluster do Google Kubernetes Engine (GKE).

- Implantação e orquestração de clusters: imagens do sistema operacional (SO)

que você usa para implantar e gerenciar a

infraestrutura otimizada para performance em

que suas cargas de trabalho de IA são executadas. É possível implantar suas cargas de trabalho de IA em clusters do GKE, do Slurm ou instâncias do Compute Engine.

Para mais informações, consulte

Visão geral da criação de VMs e clusters.

As seguintes imagens de sistema operacional estão disponíveis para implantação de cluster ou instância:

- Imagens de nós do GKE: é possível usar essas imagens para implantar clusters do GKE.

- Imagens do SO do Slurm: o Cluster Toolkit cria e implanta essas imagens, que instalam o software de sistema necessário para nós do Slurm.

- Imagens do SO do acelerador: use essas imagens para criar instâncias individuais ou em grupo.

Frameworks e bibliotecas de IA e ML

OGoogle Cloud fornece imagens do Docker que empacotam frameworks e bibliotecas de IA e ML conhecidos. Essas imagens fornecem o software necessário para simplificar o desenvolvimento, o treinamento e a implantação de modelos nos seus clusters otimizados para IA executados no Hipercomputador de IA.

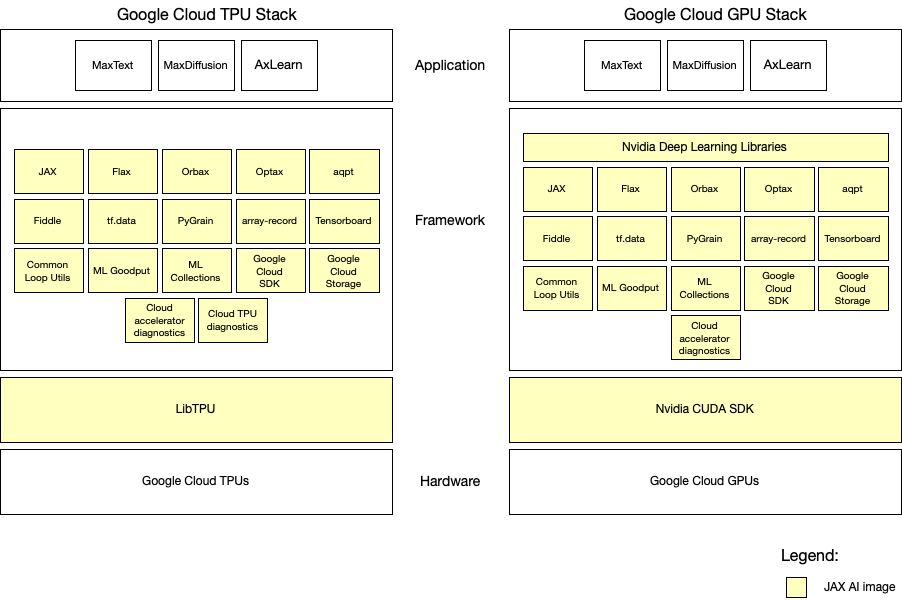

Imagens de IA do JAX

As imagens de IA do JAX (JAII, antes conhecidas como imagens de pilha estável do JAX) para TPUs e GPUsGoogle Cloud oferecem imagens Docker prontas para uso que contêm o framework JAX, uma coleção selecionada de bibliotecas compatíveis e configurações para a infraestrutura Google Cloud . As imagens de TPU de IA do JAX vêm pré-configuradas com bibliotecas do JAX e bibliotecas de TPU. As imagens de GPU de IA do JAX vêm pré-configuradas com bibliotecas JAX e CUDA/NVIDIA relevantes.

A camada de hardware

As imagens de IA do JAX ficam na parte superior da camada de hardware, que consiste nos aceleradores (TPU ou GPU) e nas VMs associadas. Para usar uma imagem de IA do JAX, é necessário provisionar VMs de TPU ou GPU. É possível fazer isso usando a API TPU, a API Compute Engine ou a API GKE.

A camada de framework

A camada de framework oferece ferramentas e bibliotecas para criar cargas de trabalho de ML. As imagens de IA do JAX oferecem uma base pré-configurada para cargas de trabalho de ML baseadas em JAX, incluindo a biblioteca principal do JAX e outras dependências essenciais, para garantir uma experiência de desenvolvimento consistente e de alta performance.

A camada LibTPU na imagem de IA do JAX é criada e agrupada especificamente com a versão correspondente do JAX. O uso de uma versão diferente do JAX pode causar comportamento ou erros inesperados.

A camada CUDA na imagem de IA do JAX inclui componentes gerenciados pela NVIDIA, como a imagem de deep learning CUDA do NGC, usada como imagem de base da imagem de treinamento de GPU. A imagem da GPU também contém o Transformer Engine, uma biblioteca personalizada da NVIDIA para acelerar modelos de transformadores em GPUs NVIDIA.

Pacotes adicionais específicos do aplicativo, além dos fornecidos na imagem de IA do JAX, podem ser necessários para sua carga de trabalho específica de machine learning.

Bibliotecas em imagens de IA do JAX:

Imagens de TPU

| Funcionalidade | Nome do pacote |

|---|---|

| Bibliotecas ou componentes principais | |

| Framework de ML | JAX e JAX lib |

| LibTPU | Versão estável da LibTPU do Cloud |

| Biblioteca de camadas/modelos | Flax |

| Como estabelecer pontos de verificação | Orbax |

| Quantização | Qwix |

| Otimizadores | Optax |

| Kernels personalizados | Tokamax |

| Configuração | Fiddle (em inglês) |

| Canal de entrada | tf.data |

| Criação de perfil e depuração | Tensorboard |

| Utils | Utilitários de loop comuns |

| Ferramentas específicas da nuvem | |

| Google Cloud | |

| Diagnósticos | |

Imagens de GPU

| Funcionalidade | Nome do pacote |

|---|---|

| Bibliotecas ou componentes principais | |

| Framework de ML | JAX e JAX lib |

| Bibliotecas NVIDIA CUDA | Imagem de DL do CUDA |

| Biblioteca de camadas/modelos | Flax |

| Como estabelecer pontos de verificação | Orbax |

| Otimizadores | |

| Configuração | Fiddle (em inglês) |

| Canal de entrada | |

| Criação de perfil e depuração | Tensorboard |

| Utils |

Utilitários de loop comuns Medição de Goodput de ML Coleções de ML |

| Ferramentas específicas da nuvem | |

| Google Cloud | |

| Diagnósticos | Diagnóstico do Cloud Accelerator |

Imagens de IA do JAX atuais

Imagens de TPU

| Imagem de IA do JAX | Data de lançamento |

|---|---|

| JAX 0.9.0, revisão 1 | 2026-02-03 |

| JAX 0.8.2, revisão 1 | 2026-01-14 |

| JAX 0.8.1, revisão 1 | 2025-11-21 |

| JAX 0.8.0, revisão 1 | 2025-10-28 |

| JAX 0.7.2, revisão 1 | 2025-09-30 |

| JAX 0.7.0, revisão 1 | 2025-07-29 |

| JAX 0.6.1, revisão 1 | 2025-06-05 |

| JAX 0.5.2 Revisão 2 | 2025-04-25 |

| JAX 0.5.2, revisão 1 | 2025-03-17 |

| JAX 0.4.37, revisão 1 | 2024-12-12 |

| JAX 0.4.35, Revisão 1 | 2024-10-30 |

Imagens de GPU

| Imagem de IA do JAX | Data de lançamento |

|---|---|

| JAX 0.7.2 com CUDA DL 25.06 Revisão 1 | 2025-09-30 |

| JAX 0.6.1 com CUDA DL 25.03 Revisão 1 | 2025-06-05 |

| JAX 0.5.1 com CUDA DL 25.02 Revisão 1 | 2025-03-17 |

A camada do aplicativo

Você implementa suas cargas de trabalho de ML específicas na camada de aplicativo, que fica acima da camada de framework. A camada de aplicativo contém o código, os modelos e a lógica específicos do aplicativo, todos criados usando as ferramentas e bibliotecas fornecidas pela camada de framework.

Embora essa imagem ofereça uma base robusta e bem testada para cargas de trabalho de IA baseadas em JAX, talvez seja necessário adicionar dependências específicas do aplicativo. Ao fazer isso, recomendamos que você minimize a interferência com a camada de base pré-configurada, que inclui o JAX e as dependências principais dele. A introdução de dependências no nível do aplicativo que substituem ou entram em conflito com as dependências atuais pode causar efeitos colaterais, como:

- Comportamentos inesperados: suas cargas de trabalho de ML podem apresentar um comportamento diferente de antes da introdução de dependências adicionais na imagem de IA do JAX.

- Regressões de performance: substituir bibliotecas otimizadas relacionadas ao JAX pode afetar negativamente os benefícios de performance oferecidos pela imagem de IA do JAX.

- Problemas de estabilidade: conflitos entre as dependências adicionadas e as principais dependências do JAX podem causar instabilidade e erros de execução no aplicativo.

Cadência de lançamento

Inicialmente, as imagens de IA do JAX são fornecidas trimestralmente, com uma meta de curto prazo de uma programação de lançamentos sincronizada com cada versão do JAX. Isso garante que você aproveite os recursos e melhorias mais recentes assim que eles forem disponibilizados.

Suporte

Cada lançamento de imagem de IA do JAX segue um ciclo de vida de suporte por tempo limitado. Dentro desse período, vamos atender a categorias específicas de solicitações de modificações em imagens de IA do JAX:

- Vulnerabilidades de segurança: priorizamos o tratamento de vulnerabilidades de segurança descobertas nas imagens base ou dependências das imagens do Docker do JAX Stable Stack. Imagens atualizadas serão lançadas para reduzir possíveis riscos.

- Mudanças interruptivas: no caso de mudanças interruptivas significativas nas bibliotecas ou estruturas subjacentes usadas pelo JAX AI Image,o Google Cloudavalia e implementa as atualizações necessárias para manter a compatibilidade. Isso pode envolver a recriação de imagens do Docker com dependências atualizadas.

Quando uma vulnerabilidade de segurança ou um bug é descoberto em uma biblioteca dentro de uma JAII, incorporamos a biblioteca atualizada à JAII, fixando todas as outras versões de biblioteca para manter a estabilidade geral. Isso resulta em uma nova revisão da JAII.

Mudança mínima para revisões:

Se um bug for encontrado no pacote "X" no JAX-0.4.30-rev1, vamos atualizar "X" para a próxima versão (por exemplo, v2.0) e tentar manter todos os outros pacotes inalterados. Isso resulta em uma nova revisão: JAX-0.4.30-rev2, que será lançada o mais rápido possível.

Imagens do Docker da camada de software de aprendizado profundo (DLSL)

Essas imagens incluem NVIDIA CUDA, NCCL, um framework de ML e um modelo. Eles oferecem um ambiente pronto para uso para cargas de trabalho de aprendizado profundo. Essas imagens do Docker de DLSL pré-criadas funcionam perfeitamente com seus clusters do GKE porque as testamos e verificamos durante os testes internos de reprodutibilidade e regressão.

As imagens do Docker do DLSL oferecem os seguintes benefícios:

- Software pré-configurado: as imagens do Docker do DLSL replicam a configuração usada pela reprodutibilidade interna e pelos testes de regressão. Essas imagens fornecem um ambiente pré-configurado, testado e otimizado, o que economiza tempo e esforço significativos na instalação e configuração.

- Gerenciamento de versões: as imagens do Docker do DLSL são atualizadas com frequência. Essas atualizações de versão fornecem a versão estável mais recente de frameworks e drivers, além de resolverem patches de segurança.

- Compatibilidade de infraestrutura: as imagens Docker do DLSL são criadas e testadas para funcionar perfeitamente com os tipos de máquinas de GPU disponíveis no Hipercomputador de IA.

- Instruções de início rápido: algumas imagens do Docker da DLSL têm receitas de amostra que mostram como iniciar cargas de trabalho que usam as imagens pré-configuradas.

NeMo + PyTorch + plug-in NCCL gIB

Essas imagens do Docker são baseadas na imagem NVIDIA NeMo NGC. Eles contêm o plug-in gIB do NCCL do Google e agrupam todos os binários do NCCL necessários para executar cargas de trabalho em cada máquina aceleradora compatível. Essas imagens também incluem ferramentas Google Cloud

como gcsfuse e a

CLI gcloud para implantar cargas de trabalho no

Google Kubernetes Engine.

| Versão de imagem DLSL | Versão das dependências | Série de máquina | Data de lançamento | Data de término do suporte | Nome da imagem DLSL |

|---|---|---|---|---|---|

nemo25.04-gib1.0.6-A4 |

|

A4 | 3 de julho de 2025 | 3 de julho de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A4

|

nemo25.04-gib1.0.6-A3U |

|

A3 Ultra | 3 de julho de 2025 | 3 de julho de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.04-gib1.0.6-A3U

|

nemo25.02-gib1.0.5-A4 |

|

A4 | 14 de março de 2025 | 14 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo25.02-gib1.0.5-A4 |

nemo24.07-gib1.0.2-A3U |

|

A3 Ultra | 2 de fevereiro de 2025 | 2 de fevereiro de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.2-A3U |

nemo24.07-gib1.0.3-A3U |

|

A3 Ultra | 2 de fevereiro de 2025 | 2 de fevereiro de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-gib1.0.3-A3U |

nemo24.12-gib1.0.3-A3U |

|

A3 Ultra | 7 de fevereiro de 2025 | 7 de fevereiro de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.12-gib1.0.3-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 de março de 2025 | 12 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12 de março de 2025 | 12 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo-nccl:nemo24.07-tcpx1.0.5-A3High |

NeMo + PyTorch

Essa imagem Docker é baseada na imagem do NVIDIA NeMo NGC e inclui ferramentas Google Cloud , como gcsfuse e a

CLI gcloud para implantar cargas de trabalho no Google Kubernetes Engine.

| Versão de imagem DLSL | Versão das dependências | Série de máquina | Data de lançamento | Data de término do suporte | Nome da imagem DLSL |

|---|---|---|---|---|---|

nemo24.07--A3U |

NeMo NGC:24.07 |

A3 Ultra | December 19, 2024 | 19 de dezembro de 2025 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-A3U |

nemo24.07-tcpx1.0.5-A3Mega |

|

A3 Mega | 12 de março de 2025 | 12 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3Mega |

nemo24.07-tcpx1.0.5-A3High |

|

A3 High (8 GPUs) | 12 de março de 2025 | 12 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/pytorch-gpu-nemo:nemo24.07-tcpx1.0.5-A3High |

MaxText + caixa de ferramentas JAX

Essa imagem Docker é baseada na imagem da caixa de ferramentas JAX da NVIDIA e incluiGoogle Cloud ferramentas como gcsfuse e a

CLI gcloud para implantar cargas de trabalho no Google Kubernetes Engine.

| Versão de imagem DLSL | Versão das dependências | Série de máquina | Data de lançamento | Data de término do suporte | Nome da imagem DLSL |

|---|---|---|---|---|---|

toolbox-maxtext-2025-01-10-A3U |

JAX toolbox: maxtext-2025-01-10 |

A3 Ultra | 11 de março de 2025 | 11 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:toolbox-maxtext-2025-01-10-A3U |

jax0.5.1-cu12-A3Mega |

|

A3 Mega | 17 de março de 2025 | 17 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3Mega |

jax0.5.1-cu12-A3High |

|

A3 High (8 GPUs) | 17 de março de 2025 | 17 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-gpu-maxtext:jax0.5.1-cu12-A3High |

MaxText + pilha estável do JAX

Essa imagem Docker é baseada na

pilha estável do JAX

e no MaxText. Essa imagem também inclui dependências, como dnsutils, para executar cargas de trabalho no Google Kubernetes Engine.

| Versão de imagem DLSL | Versão das dependências | Série de máquina | Data de lançamento | Data de término do suporte | Nome da imagem DLSL |

|---|---|---|---|---|---|

jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

|

A4 | 17 de março de 2025 | 17 de março de 2026 | us-central1-docker.pkg.dev/deeplearning-images/reproducibility/jax-maxtext-gpu:jax0.5.1-cuda_dl25.02-rev1-maxtext-20150317 |

Implantação e orquestração de cluster

As imagens do SO incluem todos os componentes de software necessários para implantar um sistema operacional em uma instância de computação ou um nó do GKE. O sistema operacional gerencia recursos de hardware subjacentes, como aceleradores e redes. Isso fornece os recursos de computação para sua carga de trabalho de IA.

Imagens de nó do GKE

O GKE implanta clusters usando imagens de nós. Essas imagens de nó estão disponíveis para vários sistemas operacionais, como Container-Optimized OS, Ubuntu e Windows Server. As imagens de nó do Container-Optimized OS com containerd (cos_containerd) que você precisa implantar nos clusters do GKE Autopilot incluem otimizações para oferecer suporte às suas cargas de trabalho de IA e ML.

Para mais informações sobre essas imagens de nó, consulte Imagens de nó.

Imagens do SO do Slurm

Os clusters do Slurm implantam nós de computação e controladores como instâncias de computação no Compute Engine.

Para provisionar clusters Slurm otimizados para IA, use o Cluster Toolkit. Durante a implantação do cluster do Slurm, o blueprint do cluster cria automaticamente uma imagem de SO personalizada que instala o software de sistema necessário para o gerenciamento de cluster e carga de trabalho nos nós do Slurm. É possível modificar os blueprints padrão antes de implantá-los para personalizar parte do software que as imagens incluem.

A seção a seguir resume o software que o modelo de cluster instala nos nós do Slurm A4, A3 Ultra, A3 Mega e A3 High (8 GPUs). Os blueprints de cluster estendem as imagens do SO do acelerador Ubuntu LTS.

A4X Max

O projeto A4X Max disponível no GitHub inclui o seguinte software por padrão:

- Ubuntu 24.04 LTS

- Slurm: versão 25.05.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: versão 5.0.x

- Cliente e servidor NFS

- Drivers da série NVIDIA 580

- NVIDIA Enroot

- NVIDIA Pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) nvidia-container-toolkit: versão 1.17.7nvidia-imexnvidia-fabricmanager

- Gerenciador de GPU do data center (

- Kit de ferramentas CUDA: versão 13.0

- Plug-in NCCL para A4X Max (

nccl-gib-a4x-max-arm64) - Driver DOCA-OFED

- Agente de operações

- Cloud Storage FUSE.

A4X

O blueprint A4X disponível no GitHub inclui o seguinte software por padrão:

- Ubuntu 24.04 LTS

- Slurm: versão 25.05.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: versão 5.0.x

- Cliente e servidor NFS

- Drivers da série NVIDIA 570

- NVIDIA Enroot

- NVIDIA Pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) nvidia-container-toolkit: versão 1.17.7nvidia-imexnvidia-fabricmanager

- Gerenciador de GPU do data center (

- CUDA Toolkit: versão 12.8

- Plug-in NCCL para A4X (

nccl-plugin-gib-arm64) - Agente de operações

- Cloud Storage FUSE.

A4

O projeto A4 disponível no GitHub inclui os seguintes softwares por padrão:

- Ubuntu 22.04 LTS

- Slurm: versão 25.05.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: a versão mais recente do 4.1.x

- PMIx: versão 4.2.9

- Cliente e servidor NFS

- Drivers da série NVIDIA 570

- Tempo de execução do contêiner NVIDIA enroot: versão 3.5.0 com correção de bugs pós-lançamento

- NVIDIA pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) nvidia-utils-570nvidia-container-toolkitlibnvidia-nscq-570

- Gerenciador de GPU do data center (

- CUDA Toolkit: versão 12.8

- Suporte ao Infiniband, incluindo

ibverbs-utils - Agente de operações

- Cloud Storage FUSE.

A3 Ultra

O blueprint do A3 Ultra disponível no GitHub inclui o seguinte software por padrão:

- Ubuntu 22.04 LTS

- Slurm: versão 24.11.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: a versão mais recente do 4.1.x

- PMIx: versão 4.2.9

- Cliente e servidor NFS

- Drivers da série NVIDIA 570

- Tempo de execução do contêiner NVIDIA enroot: versão 3.5.0 com correção de bugs pós-lançamento

- NVIDIA pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) libnvidia-cfg1-570-serverlibnvidia-nscq-570nvidia-compute-utils-570-servernsight-computensight-systems

- Gerenciador de GPU do data center (

- CUDA Toolkit: versão 12.8

- Suporte ao Infiniband, incluindo

ibverbs-utils - Agente de operações

- Cloud Storage FUSE.

A3 Mega

O projeto A3 Mega disponível no GitHub inclui o seguinte software por padrão:

- Ubuntu 22.04 LTS

- Slurm: versão 24.11.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: a versão mais recente do 4.1.x

- PMIx: versão 4.2.9

- Cliente e servidor NFS

- Drivers da série 550 da NVIDIA

- Tempo de execução do contêiner NVIDIA enroot: versão 3.4.1

- NVIDIA pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) libnvidia-cfg1-550-serverlibnvidia-nscq-550nvidia-compute-utils-550-servernsight-computensight-systems

- Gerenciador de GPU do data center (

- CUDA Toolkit: versão 12.4

- Suporte ao Infiniband, incluindo

ibverbs-utils - TCPXO para A3 Mega: instalador específico para NCCL TCPXO e a pilha de rede de 1,6 Tbps

- Agente de operações

- Cloud Storage FUSE.

A3 High

O blueprint A3 High (8 GPUs) disponível no GitHub inclui o seguinte software por padrão:

- Ubuntu 22.04 LTS

- Slurm: versão 24.11.2

- As seguintes dependências do Slurm:

mungemariadblibjwtlmod

- Open MPI: a versão mais recente do 4.1.x

- PMIx: versão 4.2.9

- Cliente e servidor NFS

- Drivers NVIDIA série 535 ou 550

- Tempo de execução do contêiner NVIDIA enroot: versão 3.4.1

- NVIDIA pyxis

- As seguintes ferramentas da NVIDIA:

- Gerenciador de GPU do data center (

dcgmi) libnvidia-cfg1-535/550-serverlibnvidia-nscq-535/550nvidia-compute-utils-535/550-servernsight-computensight-systems

- Gerenciador de GPU do data center (

- Kit de ferramentas CUDA: versão 12.2 ou 12.4

- Suporte ao Infiniband, incluindo

ibverbs-utils - TCPX para A3 High (8 GPUs): instalador específico para NCCL TCPX (GPUDirect-TCPX) e a pilha de rede de 800 Gbps (4 NICs)

- Agente de operações

- Cloud Storage FUSE.

Imagens do SO do acelerador

Com o Hipercomputador de IA, é possível provisionar instâncias de computação individuais ou grupos delas. Se você quiser criar essas instâncias, especifique uma imagem do SO durante a criação da instância.

OGoogle Cloud oferece um pacote de imagens do SO para criação de instâncias.O Google Cloud também oferece um conjunto especializado de imagens do SO de aceleradores para instâncias otimizadas para IA. Essas imagens do SO incluem drivers principais para funcionalidades de GPU e rede, como drivers NVIDIA, Mellanox e dependências.

Para mais informações sobre cada SO, consulte a página Detalhes do sistema operacional na documentação do Compute Engine.

As imagens do SO de acelerador estão disponíveis para os sistemas operacionais Rocky Linux e Ubuntu LTS.

Acelerador do Rocky Linux

As seguintes imagens do SO acelerador do Rocky Linux estão disponíveis para cada série de máquinas:

| Versão do SO | Família de imagens | Arquitetura | Série de máquina | Projeto de imagem |

|---|---|---|---|---|

| Acelerador do Rocky Linux 9 | rocky-linux-9-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-9-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570-arm64 |

Arm | A4X | rocky-linux-accelerator-cloud |

|

rocky-linux-9-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

| Acelerador do Rocky Linux 8 | rocky-linux-8-optimized-gcp-nvidia-580-arm64 |

Arm | A4X Max, A4X | rocky-linux-accelerator-cloud |

rocky-linux-8-optimized-gcp-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

|

rocky-linux-8-optimized-gcp-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | rocky-linux-accelerator-cloud |

Acelerador do Ubuntu LTS

As seguintes imagens do SO acelerador LTS do Ubuntu estão disponíveis para cada série de máquinas:

| Versão do SO | Família de imagens | Arquitetura | Série de máquina | Projeto de imagem |

|---|---|---|---|---|

| Acelerador do Ubuntu 24.04 LTS | ubuntu-accelerator-2404-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2404-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2404-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

| Acelerador do Ubuntu 22.04 LTS | ubuntu-accelerator-2204-arm64-with-nvidia-580 |

Arm | A4X Max, A4X | ubuntu-os-accelerator-images |

ubuntu-accelerator-2204-amd64-with-nvidia-580 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-arm64-with-nvidia-570 |

Arm | A4X | ubuntu-os-accelerator-images |

|

ubuntu-accelerator-2204-amd64-with-nvidia-570 |

x86 | A4, A3 Ultra, A3 Mega, A3 High (8 GPUs) | ubuntu-os-accelerator-images |