AI Hypercomputer adalah sistem superkomputer yang membantu Anda men-deploy workload kecerdasan buatan (AI) dan machine learning (ML) multi-host menggunakan mesin GPU. Layanan jaringan pokok yang Anda gunakan dalam deployment ditentukan oleh jenis mesin GPU yang Anda pilih.

Dokumen ini dimaksudkan untuk membantu arsitek, engineer jaringan, dan developer memahami layanan jaringan pokok yang terkait dengan mesin GPU. Dokumen ini mengasumsikan bahwa Anda memiliki pemahaman dasar tentang konsep jaringan cloud dan komputasi terdistribusi.

Memahami layanan jaringan mesin GPU adalah langkah pertama untuk men-deploy dan mengelola workload Anda dengan berhasil, serta penting untuk mengoptimalkan performa dan goodput. Goodput, atau throughput yang baik, mengukur kemajuan efektif yang dicapai oleh suatu sistem dalam tugas pelatihan ML. Metrik ini menawarkan insight tambahan jika dibandingkan dengan metrik seperti total waktu yang berlalu atau kecepatan throughput mentah.

Beberapa jenis mesin GPU memiliki hierarki berlapis yang berbeda yang mengoptimalkan komunikasi di setiap tingkat. Hierarki ini mencakup dari fabric pusat data hingga cluster yang dioptimalkan untuk AI dan instance Compute Engine. Bagian berikut menjelaskan komponen hierarkis ini.

Arsitektur jaringan GPU

AI Hypercomputer membantu Anda men-deploy mesin GPU yang menggunakan arsitektur jaringan hierarkis dan selaras dengan rel. Konektivitas berkinerja tinggi dan dapat diprediksi dari desain ini meminimalkan beban komunikasi, yang secara langsung meningkatkan goodput dengan memungkinkan GPU menghabiskan lebih banyak waktu untuk komputasi daripada menunggu data.

Tata letak GPU yang sesuai jalur terdiri dari tiga komponen utama:

- Sub-blok: Ini adalah unit dasar, yang terdiri dari sekelompok host yang secara fisik berada di rak yang sama. Switch pada rak teratas (ToR) menghubungkan host ini, sehingga memungkinkan komunikasi satu hop yang sangat efisien antara dua GPU mana pun di dalam sub-blok. RDMA over Converged Ethernet (RoCE) memfasilitasi komunikasi langsung ini. Library NCCL yang ditingkatkan dan dioptimalkan untuk topologi Google yang sesuai jalur menangani kolektif komunikasi GPU.

- Blok: Blok ini terdiri dari beberapa sub-blok yang saling terhubung dengan fabric non-blocking, yang memungkinkan interkoneksi berbandwidth tinggi. Setiap GPU di dalam blok dapat dijangkau dalam maksimal dua hop jaringan. Sistem mengekspos metadata blok dan sub-blok untuk memungkinkan penempatan tugas yang optimal.

- Cluster: Cluster ini dibentuk oleh beberapa blok yang saling terhubung, yang dapat diskalakan hingga ribuan GPU, dan memungkinkan Anda menjalankan workload pelatihan skala besar. Komunikasi di berbagai blok hanya menambahkan satu hop tambahan, sehingga tetap mempertahankan performa tinggi dan prediktabilitas bahkan pada skala masif. Untuk mengaktifkan penempatan tugas yang cerdas dan berskala besar, metadata tingkat cluster juga tersedia untuk orchestrator.

Teknologi untuk komunikasi GPU-ke-GPU

Mesin GPU menggunakan kombinasi teknologi untuk memberikan performa tinggi, throughput tinggi, dan latensi rendah untuk workload. Teknologi ini mencakup RDMA over Converged Ethernet (RoCE), NIC NVIDIA, dan topologi jaringan yang sesuai jalur di seluruh pusat data Google.

Jenis mesin ini menggunakan teknologi NVLink NVIDIA untuk membuat jalur data langsung berkecepatan ultra-tinggi antar-NIC NVIDIA di setiap mesin. Selain itu, RoCE memungkinkan RDMA yang efisien antar-GPU di mesin yang berbeda.

Stack jaringan GPU

Stack jejaring adalah kumpulan protokol, driver, dan lapisan software yang bekerja sama untuk menjalankan komunikasi GPU-ke-GPU. Jenis mesin GPU yang berbeda menggunakan stack jaringan yang berbeda. Tabel berikut menentukan stack jaringan dan jenis mesin terkaitnya:

| Stack jaringan | Deskripsi | Jenis mesin GPU |

|---|---|---|

| GPUDirect RDMA | GPUDirect RDMA memungkinkan jalur langsung untuk pertukaran data antara GPU dan perangkat lain. Untuk instance A4X Max dan A4X, stack jaringan ini menggunakan RDMA over Converged Ethernet (RoCE). Teknologi ini memungkinkan perangkat peer membaca dan menulis langsung ke memori GPU, melewati CPU untuk membuat koneksi yang lebih efisien untuk pertukaran data berperforma tinggi. Untuk mengetahui informasi selengkapnya, lihat Opsi konfigurasi cluster dengan GPUDirect RDMA. | |

| GPUDirect-TCPXO | GPUDirect-TCPXO meningkatkan kualitas GPUDirect-TCPX dengan mengurangi beban protokol TCP. Dengan GPUDirect-TCPXO, jenis mesin A3 Mega menggandakan bandwidth jaringan dibandingkan dengan jenis mesin A3 High dan A3 Edge. Untuk mengetahui informasi tentang cara memaksimalkan bandwidth jaringan pada cluster GKE yang menggunakan GPUDirect-TCPXO, lihat Memaksimalkan bandwidth jaringan GPU dalam cluster mode Standar dan pilih tab GPUDirect-TCPXO. | |

| GPUDirect-TCPX | GPUDirect-TCPX meningkatkan performa jaringan dengan memungkinkan payload paket data ditransfer langsung dari memori GPU ke antarmuka jaringan. Untuk mengetahui informasi tentang cara memaksimalkan bandwidth jaringan pada cluster GKE yang menggunakan GPUDirect-TCPX, lihat Memaksimalkan bandwidth jaringan GPU dalam cluster mode Standard dan pilih tab GPUDirect-TCPX. |

Jaringan bidang data host dan penyimpanan

Jalur jaringan terpisah menangani semua traffic yang bukan termasuk komunikasi langsung GPU-ke-GPU. Traffic ini mencakup akses ke Cloud Storage, pengelolaan tingkat host, dan komunikasi dengan layanan Google Cloud lainnya. Untuk mengelola traffic ini, jenis mesin GPU menggunakan NIC Titanium Google.

NIC Titanium mengurangi beban tugas pemrosesan jaringan dari CPU, sehingga CPU dapat fokus pada workload Anda. Pemisahan ini memastikan bahwa traffic serbaguna dan traffic GPU-ke-GPU khusus menggunakan antarmuka fisik yang berbeda, sehingga mencegah keduanya bersaing untuk resource sistem yang sama.

Lingkungan Multi-VPC

Semua workload beroperasi dalam Virtual Private Cloud (VPC) Google Cloud.

Mesin akselerator berperforma tinggi memiliki desain hardware khusus yang menggunakan beberapa antarmuka jaringan fisik untuk menangani berbagai jenis traffic. Untuk menangani desain hardware khusus ini, lingkungan multi-VPC diperlukan, terlepas dari apakah Anda menggunakan Slurm, GKE, atau Compute Engine untuk menjalankan workload.

Konfigurasi multi-VPC tertentu bergantung pada jenis mesin GPU dan stack jaringannya:

A4X Max, A4X, A4, dan A3 Ultra dengan GPUDirect RDMA: Mesin ini menggunakan jaringan VPC default untuk traffic host tujuan umum (gVNIC) dan memerlukan satu jaringan VPC tambahan untuk traffic host tujuan umum, dan satu jaringan VPC bersama untuk semua traffic antar-GPU. VPC traffic GPU harus mengaktifkan profil jaringan RDMA. Untuk mengetahui informasi selengkapnya tentang konfigurasi ini untuk VM A4 dan VM A3 Ultra, lihat Membuat VPC dan subnet.

A3 Mega dengan GPUDirect-TCPXO: Mesin ini memerlukan delapan VPC terpisah untuk NIC GPU, yang dikhususkan untuk komunikasi ber-bandwidth tinggi. Untuk mengetahui langkah-langkah mendetail tentang cara menyelesaikan konfigurasi ini, lihat Membuat VPC dan subnet.

A3 Tinggi dengan GPUDirect-TCPX: Mesin ini memerlukan empat VPC terpisah untuk NIC GPU, yang dikhususkan untuk komunikasi ber-bandwidth tinggi. Untuk mengetahui langkah-langkah mendetail tentang cara menyelesaikan konfigurasi ini, lihat Membuat VPC dan subnet.

Konfigurasi multi-VPC ini memastikan bahwa operasi penyimpanan dan tugas sistem lainnya tidak bersaing untuk mendapatkan bandwidth dengan komunikasi GPU-ke-GPU yang penting.

Konfigurasi jaringan multi-VPC yang diperlukan yang harus Anda siapkan berbeda-beda berdasarkan jenis mesin GPU Anda. Untuk panduan mendetail tentang pengaturan jaringan, kecepatan bandwidth, dan NIC untuk semua jenis mesin GPU yang didukung, lihat Jaringan dan mesin GPU.

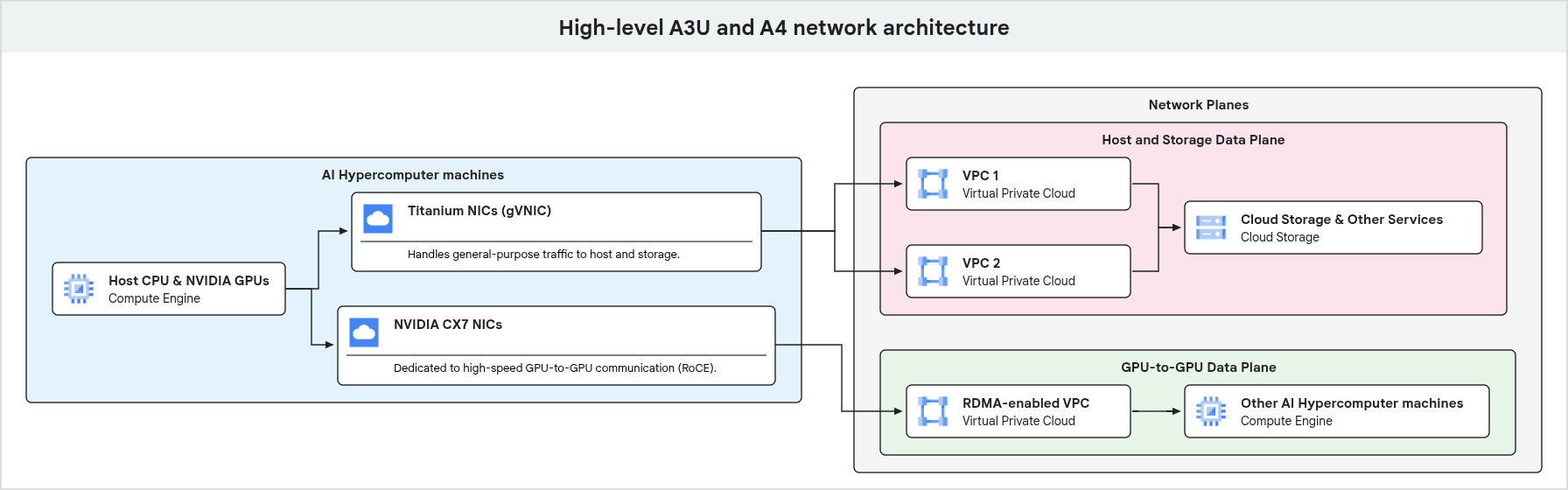

Diagram berikut menunjukkan arsitektur jaringan untuk mesin GPU, yang menyoroti pemisahan traffic serbaguna dan traffic GPU-ke-GPU khusus ke bidang jaringan yang berbeda.

Seperti yang ditunjukkan dalam diagram sebelumnya, mesin GPU menggunakan jalur jaringan khusus untuk berbagai jenis traffic. Traffic tujuan umum, termasuk akses pengelolaan dan penyimpanan, mengalir melalui NIC Titanium Google yang terhubung ke VPC. Komunikasi GPU-ke-GPU berperforma tinggi menggunakan antarmuka jaringan dan VPC terpisah, yang dioptimalkan dengan teknologi seperti RDMA, sehingga memastikan bandwidth tinggi dan latensi rendah untuk workload AI dan ML.

Library dan komponen jejaring

Untuk memaksimalkan bandwidth dan performa jaringan, library dan komponen jaringan berikut memungkinkan Anda menggunakan GPU dengan stack jaringan Google:

- gVNIC: NIC Virtual Google (gVNIC) adalah antarmuka jaringan virtual yang dirancang khusus untuk Compute Engine. gVNIC meningkatkan performa, meningkatkan konsistensi, dan mengurangi masalah noisy neighbor. gVNIC didukung dan direkomendasikan di semua kelompok mesin, jenis mesin, dan generasi, serta merupakan vNIC yang direkomendasikan untuk komunikasi host-ke-host. Untuk informasi selengkapnya, lihat Menggunakan NIC Virtual Google.

- NCCL: NVIDIA Collective Communications Library (NCCL) menyediakan primitive yang dioptimalkan untuk operasi komunikasi kolektif. Fitur ini dirancang khusus untuk lingkungan multi-GPU dan multi-node, menggunakan GPU dan jaringan NVIDIA. Jalankan pengujian NCCL untuk mengevaluasi performa cluster yang di-deploy. Untuk mengetahui informasi selengkapnya, lihat Men-deploy dan menjalankan tes NCCCL.

- Multi-jaringan GKE: Dukungan multi-jaringan untuk Pod memungkinkan beberapa antarmuka pada node dan Pod di cluster GKE. Untuk mengetahui detail cara menyiapkan multi-jaringan dalam konteks GPUDirect, lihat Memaksimalkan bandwidth jaringan GPU di cluster mode Standar dan Opsi konfigurasi cluster dengan GPUDirect RDMA.

Untuk mengetahui detail selengkapnya tentang stack software yang tersedia, lihat Image OS dan Docker.

Langkah berikutnya

- Pelajari layanan jaringan untuk deployment cluster dan VM.

- Pelajari praktik terbaik untuk jaringan di AI Hypercomputer.

- Pelajari jenis mesin GPU dan layanan penyimpanan untuk AI Hypercomputer.