最新の ML フレームワークでは多くの場合、GPU 間通信プリミティブに NVIDIA Collective Communications Library(NCCL)を使用しています。

NCCL の Google 拡張バージョンは NCCL/gIB と呼ばれ、 Google Cloudの A3 Ultra、A4、A4X VM で使用できます。NCCL/gIB は、Google インフラストラクチャ上のアップストリーム NCCL よりもパフォーマンスが優れていることがよくあります。NCCL のパフォーマンスはワークロード全体のパフォーマンスに影響する可能性があるため、NCCL/gIB を使用することをおすすめします。

NCCL/gIB には、次のような Google 固有の機能と最適化が含まれています。

- gIB ネットワーク プラグインは、Google のネットワークでロード バランシングを改善し、集団オペレーション中に高スループットと低レイテンシをより一貫して実現します。

- Google Cloud VM で最適なチューニング オプションを選択するカスタム チューナー プラグイン。

- CoMMA プロファイラ プラグインは、ワークロードの詳細なパフォーマンス指標と診断データを提供します。

- env プラグインは、 Google Cloud VM 全体でプラットフォーム固有の変数構成を提供します。

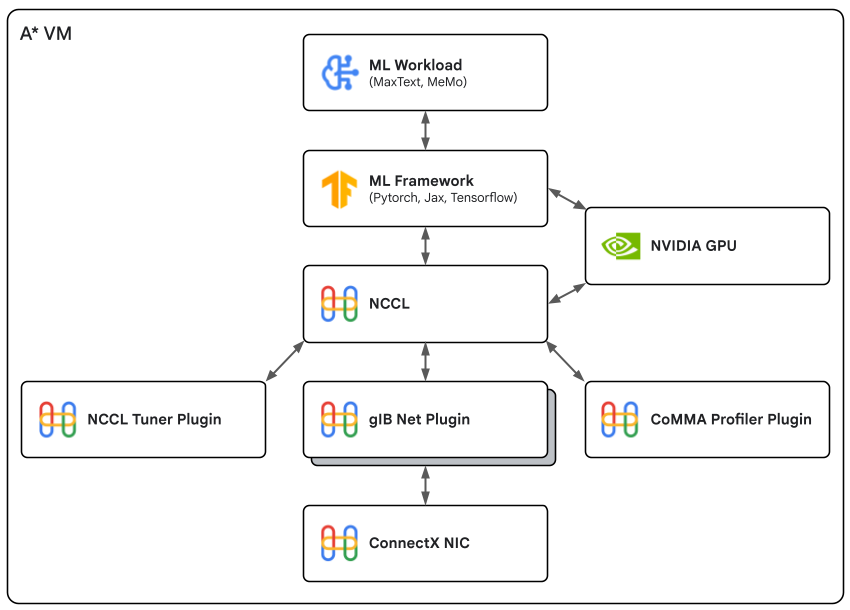

NCCL/gIB アーキテクチャ

NCCL/gIB は、次の図に示すように、クラスタ上の ML フレームワークと NVIDIA GPU と連携して、パフォーマンスを最適化し、テレメトリーを収集します。

NCCL/gIB を使用するメリット

安定性の問題なく Google Cloud VM でアップストリームの NVIDIA Collective Communications Library を使用することはできますが、NCCL/gIB は Google Cloud 向けに最適化されています。同じ NCCL パラメータを使用しても、特定の通信パターンではパフォーマンスの差が非常に大きくなることがあります。

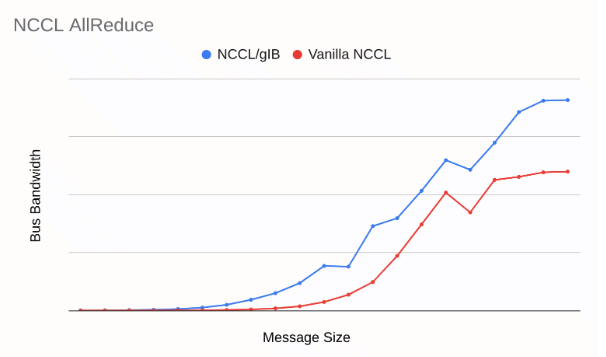

たとえば、次のグラフは、AllReduce パフォーマンスでの NCCL/gIB とアップストリーム NCCL の比較を示しています。NCCL/gIB は、特定のメッセージ サイズでアップストリーム NCCL の最大 12 倍のパフォーマンスを発揮します。

バックグラウンド トラフィックのない A3 Ultra(H200)を使用した 32 ノードの NCCL AllReduce パフォーマンス。

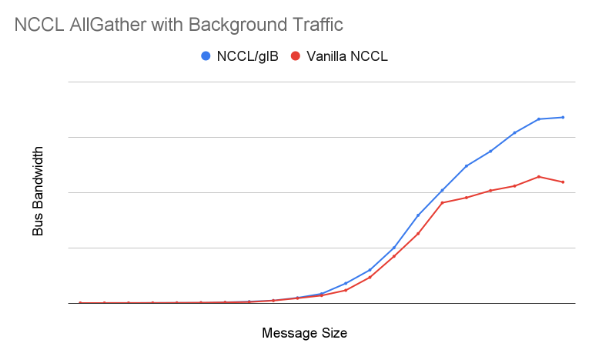

同様に、バックグラウンド トラフィックでの AllGather パフォーマンスで NCCL/gIB とアップストリーム NCCL を比較すると、このグラフに示すように、NCCL/gIB は大きなメッセージ サイズでアップストリーム NCCL を約 50% 上回っています。

ノイズの多いバックグラウンドで共有ファブリック上の A3 Ultra(H200)を使用した場合の 32 ノードの NCCL AllGather パフォーマンス。

また、CoMMA プロファイラ プラグインにより、Google はカスタム テレメトリーを改善し、ワークロード レベルの問題が発生した場合に、より適切にサポートできるようになります。

NCCL/gIB の使用

クラスタで NCCL/gIB テストを実行するには、次のリストから要件に最も適したページを選択します。

- Compute Engine VM で NCCL テストを実行する

- デフォルト構成を使用する GKE クラスタで NCCL を実行する

- A4X を使用するカスタム GKE クラスタで NCCL を実行する

- A4 または A3 Ultra を使用するカスタム GKE クラスタで NCCL を実行する

- Slurm クラスタで NCCL テストを実行する

- Cluster Director で NCCL テストを実行する

テストの実行後にクラスタで発生した問題に対処する方法については、トラブルシューティングのために NCCL/GiB ログを収集して理解するをご覧ください。